JAVA

新学四问

WHY【与前代优化了什么,弥补了什么空白】筑基,越深越稳

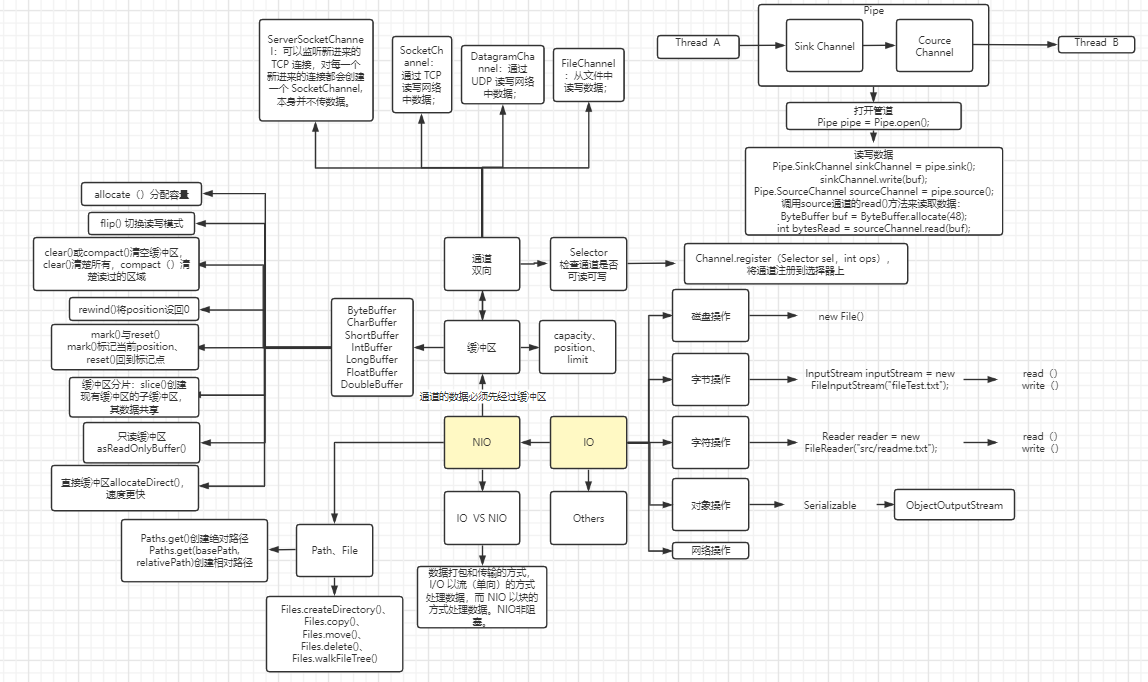

WHAT【框架,思维导图,主题框架】容器、并发、IO、NET、JVM、其他

HOW【如何记忆,学习资源】:https://github.com/CyC2018、博客完善、书籍深入、ANKI稳固、熟悉基础数据结构

LEVEL【不是每个都学精】精通

TODO

- [ ]

学习记录

综合问题

增强for和普通for区别?

需要循环数组结构的数据时,建议使用普通for循环,因为for循环采用下标访问,对于数组结构的数据来说,采用下标访问比较好。需要循环链表结构的数据时,一定不要使用普通for循环,这种做法很糟糕,数据量大的时候有可能会导致系统崩溃。for循环是随机读取,增强for的底层是迭代器,属于顺序读取。ArrayList实现了RandomAccess标记性接口,可以显著提升随机读取的效率;而linkedlist没有实现RandomAccess接口,随机读取会很慢

数据结构

哈希

**核心理论:**Hash也称散列、哈希,对应的英文都是Hash。基本原理就是把任意长度的输入,通过Hash算法变成固定长度的输出。这个映射的规则就是对应的Hash算法,而原始数据映射后的二进制串就是哈希值。

Hash的特点:

1.hash值不可以反向推导出原始的数据

2.输入数据的微小变化会得到完全不同的hash值,相同的数据会得到相同的值

3.哈希算法的执行效率要高效,长的文本也能快速地计算出哈希值

4.hash算法的冲突概率要小

由于hash的原理是将输入空间的值映射成hash空间内,而hash值的空间远小于输入的空间。根据抽屉原理,一定会存在不同的输入被映射成相同输出的情况。抽屉原理:桌上有十个苹果,要把这十个苹果放到九个抽屉里,无论怎样放,我们会发现至少会有一个抽屉里面放不少于两个苹果,这一现象就是我们所说的抽屉原理。

红黑树

R-B Tree,全称是Red-Black Tree,又称为“红黑树”,它一种特殊的二叉查找树。红黑树的每个节点上都有存储位表示节点的颜色,可以是红(Red)或黑(Black)。

红黑树的特性:

(1)每个节点或者是黑色,或者是红色。

(2)根节点是黑色。

(3)每个叶子节点(NIL)是黑色。 [注意:这里叶子节点,是指为空(NIL或NULL)的叶子节点!]

(4)如果一个节点是红色的,则它的子节点必须是黑色的。

(5)从一个节点到该节点的子孙节点的所有路径上包含相同数目的黑节点。

注意:

(01) 特性(3)中的叶子节点,是只为空(NIL或null)的节点。

(02) 特性(5),确保没有一条路径会比其他路径长出俩倍。因而,红黑树是相对是接近平衡的二叉树。

红黑树示意图如下:

如何阅读源码?

方法:

1.实践断点

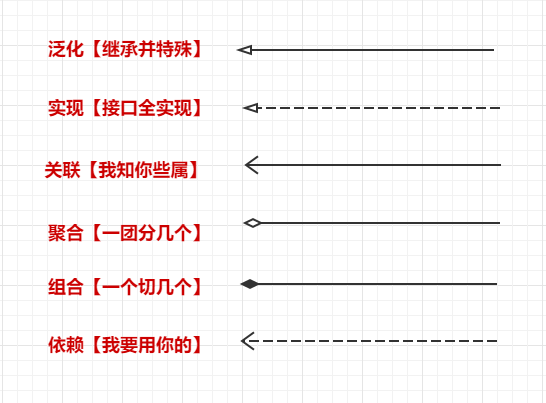

2.顺序:接口$\longrightarrow$实现类((方法【属性--》判断】)构造器方法$\longrightarrow$常用方法$\longrightarrow$其他方法)

3.工具:IDEA 的 Diagram 图标化查看继承结构,所有类的所有结构,双击跳转对应类.左下角Structure查看类结构。ctrl+H查看继承树。

4.注释:查看注释

5.快捷键:

6.根据已知看未知:比如已知底层看源码,线程安全看原理

项目

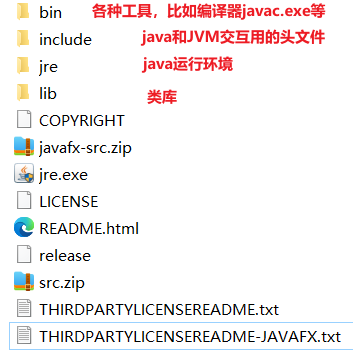

JDK

常用包:【java.io java.lang java.util】

【java.lang.reflect java.net javax.net.* java.nio.* java.util.concurrent.】

框架

容器

学习流程

进度:

collection$\longrightarrow$list$\longrightarrow$set$\longrightarrow$map$\longrightarrow$queue

方法:

总结特点$\longrightarrow$根据特点查看源码 $\longrightarrow$笔记

总结

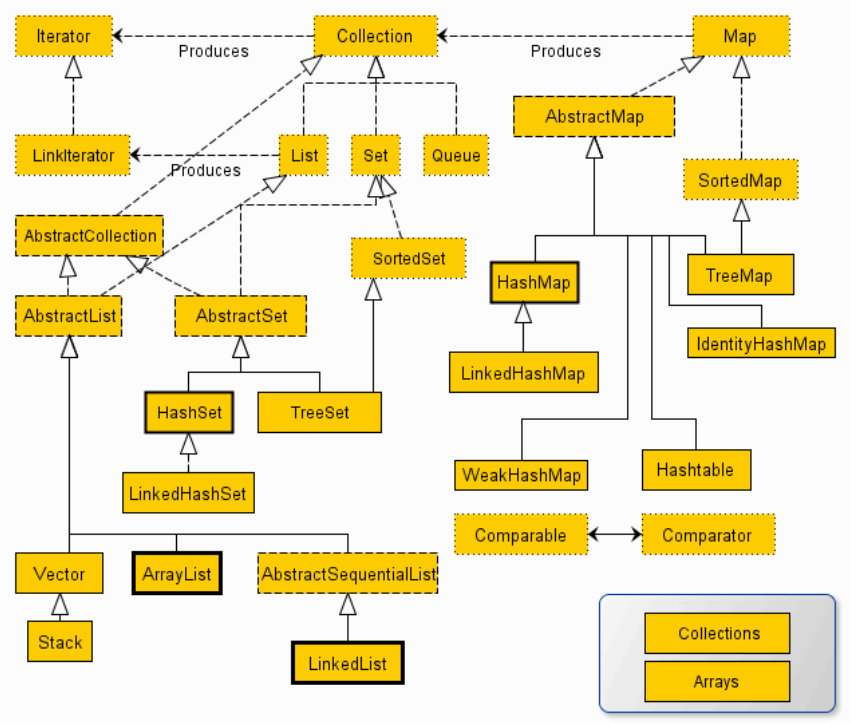

总关系图

表格总结

| 集合名称 | 结构 | 是否可重复 | 是否线程安全 | 是否可为空 | 是否有序 | 扩容倍数 | 增 | 删 | 改 | 查 |

|---|---|---|---|---|---|---|---|---|---|---|

| List | ||||||||||

| Vector | 动态数组【Object [ ] 】 | 可重 | 安 | 多空共存 | 有序 | 2 | ||||

| ArrayList | 动态数组【Object [ ] 】 | 可重 | 不安 | 多空共存 | 有序 | 1.5 | 尾💚 | 尾💚 | 💚 | |

| LinkedList | 双向循环链表 | 可重 | 不安 | 多空共存 | 有序 | 链表无 | 💚 | 💚 | ||

| Set | ||||||||||

| TreeSet | 红黑树【red-black tree】 | 不重 | 不安 | 默认非空,自定义实现Comparator接口可存储null | 有序 | 红黑树无 | O(logN) | |||

| HashSet | 哈希表【HashMap】 | 不重 | 不安 | 多空单存 | 无序 | 2 | 💚 | O(1)💚 | ||

| LinkedHashSet | 双向链表【LinkedHashMap】 | 不重 | 不安 | 多空单存 | 有序 | 2 | ||||

| Map | ||||||||||

| HashMap | 数组+链表(1.8之后链表长度大于默认8且数组长度大于64转换为红黑树),散列(哈希)表 | 值可重 | 不安 | 多空键值或单空键或值 | 无序 | 2 | ||||

| TreeMap | 红黑树(自平衡的排序二叉树) | 值可重 | 不安 | 可值空共存 | 有序 | 红黑树无 | ||||

| LinkedHashMap | 底层哈希表+双向链表,HashMap子类 | 值可重 | 不安 | 多空键值或单空键或值 | 有序 | 2 | ||||

| ConcurrentHashMap | 1.8之后 数组、链表/红黑树 适合多线程 | 值可重 | 安 | 非空 | 2 | |||||

| 【保留】Hashtable | 安 | |||||||||

| Queue | ||||||||||

| PriorityQueue | 二叉小顶堆,每次取出权值最小元素,先进先出 | 安 | 非 | |||||||

Collection

集合根接口,定义子类基础操作

遍历方式

foreach

Iterator

listiterator:区别:List专用、遍历时可添加元素、可逆向遍历、可定位当前索引位置、可修改遍历对象。

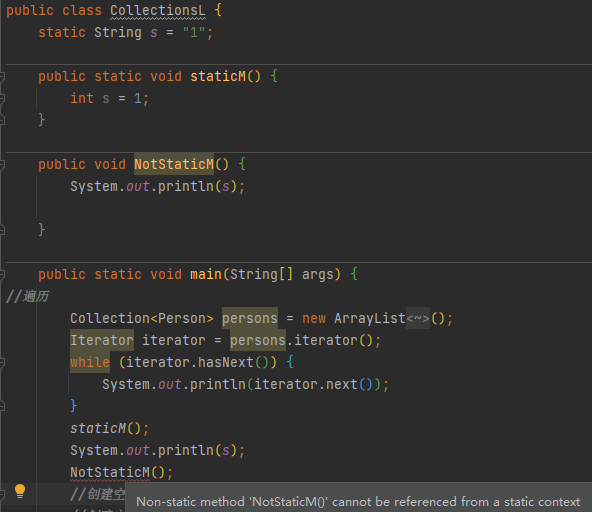

Collection\<Person> persons = new ArrayList\<Person>();

Iterator iterator = persons.iterator();

while (iterator.hasNext()) {

System.out.println(iterator.next);

}aggregate operations

Collection\<Person> persons = new ArrayList\<Person>();

persons

.stream()

.forEach(new Consumer\<Person>() {

@Override

public void accept(Person person) {

System.out.println(person.name);

}

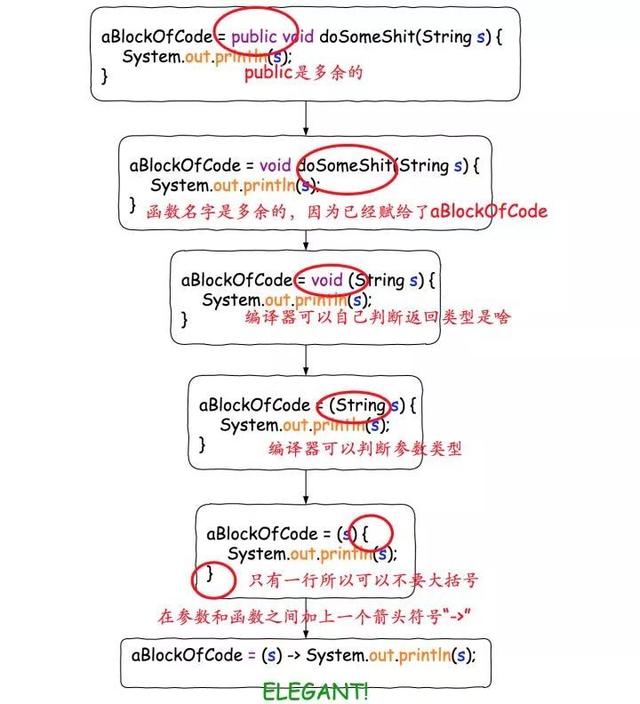

});//在 JDK 8 以后,推荐使用聚合操作对一个集合进行操作。聚合操作通常和 lambda 表达式结合使用,让代码看起来更简洁(因此可能更难理解)。下面举几个简单的栗子:

//1.使用流来遍历一个 ShapesCollection,然后输出红色的元素:

myShapesCollection.stream()

.filter(e -> e.getColor() == Color.RED)

.forEach(e -> System.out.println(e.getName()));

//你还可以获取一个并行流(parallelStream),当集合元素很多时使用并发可以提高效率:

myShapesCollection.parallelStream()

.filter(e -> e.getColor() == Color.RED)

.forEach(e -> System.out.println(e.getName()));

//聚合操作还有很多操作集合的方法,比如说你想把 Collection 中的元素都转成 String 对象,然后把它们 连起来:

String joined = elements.stream()

.map(Object::toString)

.collect(Collectors.joining(", "));

//Thanks:https://blog.csdn.net/u011240877/article/details/52773577List

插入有序可重可多空

Vector

底层数组,同步,同步让其比AL慢,内存不够默认扩100%

| 特点 | 原因(源码) | |

|---|---|---|

| 与 ArrayList 相似 | ||

| 线程安全 | 方法中有synchronized,所以性能不如ArrayList | |

| 动态扩容为原来的2倍 | int newCapacity = oldCapacity + ((capacityIncrement > 0) ? capacityIncrement : oldCapacity); | |

可排序扩容为原来两倍

private void grow(int minCapacity) {

// overflow-conscious code

int oldCapacity = elementData.length;

//扩容为原来两倍

int newCapacity = oldCapacity + ((capacityIncrement > 0) ?

capacityIncrement : oldCapacity);

if (newCapacity - minCapacity \< 0)

newCapacity = minCapacity;

if (newCapacity - MAX_ARRAY_SIZE > 0)

newCapacity = hugeCapacity(minCapacity);

elementData = Arrays.copyOf(elementData, newCapacity);

}ArrayList

| 特点 | 原因(源码) | |

|---|---|---|

| 底层数组 | new Object[initialCapacity]; | |

| 查优,尾增删快,其他地方增删慢 | 底层数组 | |

| 动态扩容原来的1.5倍 | int newCapacity = oldCapacity + (oldCapacity >> 1); | |

| 线程不安全 | 方法中没有synchronized<br />/**This class is roughly equivalent to<br/> * <tt>Vector</tt>, except that it is unsynchronized.*/ | |

| 支持快速随机访问 | RandomAccess | |

动态扩容

/**

* Increases the capacity to ensure that it can hold at least the

* number of elements specified by the minimum capacity argument.

*

* @param minCapacity the desired minimum capacity

*/

private void grow(int minCapacity) {

// overflow-conscious code

int oldCapacity = elementData.length;

//====== 动态扩容:位运算 >>:右移运算符 oldCapacity >> 1 ---》 M >> n = M / 2^n 即扩容50%======

int newCapacity = oldCapacity + (oldCapacity >> 1);

if (newCapacity - minCapacity \< 0)

newCapacity = minCapacity;

if (newCapacity - MAX_ARRAY_SIZE > 0)

newCapacity = hugeCapacity(minCapacity);

// minCapacity is usually close to size, so this is a win:

elementData = Arrays.copyOf(elementData, newCapacity);

}参考:位运算:M >> n = M / 2^n

总结

LinkedList

| 特点 | 原因(源码) | |

|---|---|---|

| 底层双向链表,增删优,可操作头尾,用作栈、(双向)队列 | 底层双向链表 | |

| 可插入空 | 底层双向链表 | |

| 查询慢 | 底层双向链表,会遍历整个链表 | |

| 线程不安全 | 方法中没有synchronized | |

底层双向链表

/**

* Returns the (non-null) Node at the specified element index.

*/

Node\<E> node(int index) {

// assert isElementIndex(index);

if (index \< (size >> 1)) {

Node\<E> x = first;

for (int i = 0; i \< index; i++)

x = x.next;

return x;

} else {

Node\<E> x = last;

for (int i = size - 1; i > index; i--)

x = x.prev;

return x;

}

}

/**

* Inserts all of the elements in the specified collection into this

* list, starting at the specified position. Shifts the element

* currently at that position (if any) and any subsequent elements to

* the right (increases their indices). The new elements will appear

* in the list in the order that they are returned by the

* specified collection's iterator.

*

* @param index index at which to insert the first element

* from the specified collection

* @param c collection containing elements to be added to this list

* @return {@code true} if this list changed as a result of the call

* @throws IndexOutOfBoundsException {@inheritDoc}

* @throws NullPointerException if the specified collection is null

*/

public boolean addAll(int index, Collection\<? extends E> c) {

checkPositionIndex(index);

Object[] a = c.toArray();

int numNew = a.length;

if (numNew == 0)

return false;

Node\<E> pred, succ;

if (index == size) {

succ = null;

pred = last;

} else {

succ = node(index);

pred = succ.prev;

}

for (Object o : a) {

@SuppressWarnings("unchecked") E e = (E) o;

Node\<E> newNode = new Node\<>(pred, e, null);

if (pred == null)

first = newNode;

else

pred.next = newNode;

pred = newNode;

}

if (succ == null) {

last = pred;

} else {

pred.next = succ;

succ.prev = pred;

}

size += numNew;

modCount++;

return true;

}总结

Stack

后进先出的堆栈

Set

无序不重单空,常用于去重

TreeSet

| 特点 | 原因(源码) | |

|---|---|---|

| 底层TreeMap | 底层、可排序 | |

| 可排序【自然排序,定制排序】 | 底层、可排序 | |

| 线程不安全 | 方法中没有synchronized | |

| 默认非空,自定义实现Comparator接口可存储null | ||

底层、可排序底层、可排序

public interface NavigableSet\<E> extends SortedSet\<E> {}

public class TreeSet\<E> extends AbstractSet\<E>

implements NavigableSet\<E>, Cloneable, java.io.Serializable

{}

// Integer能排序(有默认顺序), String能排序(有默认顺序),可以对对象元素进行排序,但是自定义类需要实现comparable接口,重写comparaTo() 方法,否则:{@code ClassCastException}报ClassCastException异常。所有元素必须可以相互比较(相同类型),否则将会报类型转换异常ClassCastExection

/**

* Constructs a new, empty tree set, sorted according to the

* natural ordering of its elements. All elements inserted into

* the set must implement the {@link Comparable} interface.

* Furthermore, all such elements must be \<i>mutually

* comparable\</i>: {@code e1.compareTo(e2)} must not throw a

* {@code ClassCastException} for any elements {@code e1} and

* {@code e2} in the set. If the user attempts to add an element

* to the set that violates this constraint (for example, the user

* attempts to add a string element to a set whose elements are

* integers), the {@code add} call will throw a

* {@code ClassCastException}.

*/

public TreeSet() {

this(new TreeMap\<E,Object>());

}TreeSet的排列顺序与重写的compareTo()方法的返回值有关。

return 0:元素每次进行比较,都认为是相同的元素,这是就不再向TreeSet里面插入除第一个元素以外的元素,所以TreeSet中就只插入了一个元素。

return 1:元素每次进行比较,都认为新插入的元素比上一个元素大,于是二叉树存储时,会储存在根的右侧,读取时就是正序排列,先进先出。

return -1:元素每次进行比较,都认为新插入的元素比上一个元素小,于是二叉树存储时,会储存在根的左侧,读取时就是倒序排列,先进后出。

HashSet

学习前最好先学习 HashMap

| 特点 | 原因(源码) | |

|---|---|---|

| 底层HashMap | 底层HashMap | |

| 可单空 | Map的key唯一 | |

| 善存取 | 散列表定位 | |

| 无序 | 没继承SortedSet | |

| 不安 | 方法中没有synchronized | |

| 不重复 | 不重复 | |

| 2倍扩容 | 同hashmap |

底层HashMap

private transient HashMap\<E,Object> map;

// Dummy value to associate with an Object in the backing Map

private static final Object PRESENT = new Object();

/**

* Constructs a new set containing the elements in the specified

* collection. The \<tt>HashMap\</tt> is created with default load factor

* (0.75) and an initial capacity sufficient to contain the elements in

* the specified collection.

*

* @param c the collection whose elements are to be placed into this set

* @throws NullPointerException if the specified collection is null

*/

public HashSet(Collection\<? extends E> c) {

//初始16,加载因子0.75

map = new HashMap\<>(Math.max((int) (c.size()/.75f) + 1, 16));

addAll(c);

}

//HashSet中的元素都存放在HashMap的key上面,而value中的值都是统一的一个固定对象private static final Object PRESENT = new Object();不重复

/**

* Adds the specified element to this set if it is not already present.

* More formally, adds the specified element \<tt>e\</tt> to this set if

* this set contains no element \<tt>e2\</tt> such that

* \<tt>(e==null ? e2==null : e.equals(e2))\</tt>.

* If this set already contains the element, the call leaves the set

* unchanged and returns \<tt>false\</tt>.

*

* @param e element to be added to this set

* @return \<tt>true\</tt> if this set did not already contain the specified

* element

*/

public boolean add(E e) {

return map.put(e, PRESENT)==null;

}

/**

* Associates the specified value with the specified key in this map.

* If the map previously contained a mapping for the key, the old

* value is replaced.

*

* @param key key with which the specified value is to be associated

* @param value value to be associated with the specified key

* @return the previous value associated with \<tt>key\</tt>, or

* \<tt>null\</tt> if there was no mapping for \<tt>key\</tt>.

* (A \<tt>null\</tt> return can also indicate that the map

* previously associated \<tt>null\</tt> with \<tt>key\</tt>.)

*/

public V put(K key, V value) {

return putVal(hash(key), key, value, false, true);

}

/**

* Implements Map.put and related methods

*

* @param hash hash for key

* @param key the key

* @param value the value to put

* @param onlyIfAbsent if true, don't change existing value

* @param evict if false, the table is in creation mode.

* @return previous value, or null if none

*/

final V putVal(int hash, K key, V value, boolean onlyIfAbsent,

boolean evict) {

Node\<K,V>[] tab; Node\<K,V> p; int n, i;

if ((tab = table) == null || (n = tab.length) == 0)

n = (tab = resize()).length;

if ((p = tab[i = (n - 1) & hash]) == null)

tab[i] = newNode(hash, key, value, null);

else {

Node\<K,V> e; K k;

if (p.hash == hash &&

((k = p.key) == key || (key != null && key.equals(k))))

e = p;

else if (p instanceof TreeNode)

e = ((TreeNode\<K,V>)p).putTreeVal(this, tab, hash, key, value);

else {

for (int binCount = 0; ; ++binCount) {

if ((e = p.next) == null) {

p.next = newNode(hash, key, value, null);

if (binCount >= TREEIFY_THRESHOLD - 1) // -1 for 1st

treeifyBin(tab, hash);

break;

}

if (e.hash == hash &&

((k = e.key) == key || (key != null && key.equals(k))))

break;

p = e;

}

}

if (e != null) { // existing mapping for key

V oldValue = e.value;

if (!onlyIfAbsent || oldValue == null)

e.value = value;

afterNodeAccess(e);

return oldValue;

}

}

++modCount;

if (++size > threshold)

resize();

afterNodeInsertion(evict);

return null;

}LinkedHashSet

| 特点 | 原因(源码) | |

|---|---|---|

| 底层链表【LinkedHashMap】 | 底层 | |

| 不安 | 方法中没有synchronized | |

| 插入有序 | LinkedHashSet在遍历时获得的迭代器是LinkedHashSet所实现的LinkedKeyIterator,它的遍历是从双向链表头开始顺序遍历,实现了有序输出。 | |

| 不重复 | 类似不重复 | |

底层

/**

* Constructs a new linked hash set with the same elements as the

* specified collection. The linked hash set is created with an initial

* capacity sufficient to hold the elements in the specified collection

* and the default load factor (0.75).

*

* @param c the collection whose elements are to be placed into

* this set

* @throws NullPointerException if the specified collection is null

*/

public LinkedHashSet(Collection\<? extends E> c) {

super(Math.max(2*c.size(), 11), .75f, true);

addAll(c);

}

public class LinkedHashSet\<E>

extends HashSet\<E>

implements Set\<E>, Cloneable, java.io.Serializable {}

/**

* Constructs a new, empty linked hash set. (This package private

* constructor is only used by LinkedHashSet.) The backing

* HashMap instance is a LinkedHashMap with the specified initial

* capacity and the specified load factor.

*

* @param initialCapacity the initial capacity of the hash map

* @param loadFactor the load factor of the hash map

* @param dummy ignored (distinguishes this

* constructor from other int, float constructor.)

* @throws IllegalArgumentException if the initial capacity is less

* than zero, or if the load factor is nonpositive

*/

HashSet(int initialCapacity, float loadFactor, boolean dummy) {

map = new LinkedHashMap\<>(initialCapacity, loadFactor);

}Map

键值对,键不重

HashMap

推荐资源:博客1

| 特点 | 原因(源码) | |

|---|---|---|

| 底层为数组称之为哈希桶,每个桶里面放的是链表,链表中的每个节点,就是哈希表中的每个元素。<br/>JDK8后,链表容量大于8且桶的容量大于64,转化成红黑树 | 底层 | |

| 线程不安全 | 方法中没有synchronized | |

| 默认长度16 | 初始容量 | |

| 扩容为原来的两倍 | 扩容 | |

| 无序 | 无序,可空 | |

| 多空键值或单空键或值 | 无序,可空 |

底层

/** Node 单向链表

* Basic hash bin node, used for most entries. (See below for

* TreeNode subclass, and in LinkedHashMap for its Entry subclass.)

*/

static class Node\<K,V> implements Map.Entry\<K,V> {

final int hash;

final K key;

V value;

//碰撞之后形成链表

Node\<K,V> next;

Node(int hash, K key, V value, Node\<K,V> next) {

this.hash = hash;

this.key = key;

this.value = value;

this.next = next;

}

public final K getKey() { return key; }

public final V getValue() { return value; }

public final String toString() { return key + "=" + value; }

public final int hashCode() {

return Objects.hashCode(key) ^ Objects.hashCode(value);

}

public final V setValue(V newValue) {

V oldValue = value;

value = newValue;

return oldValue;

}

public final boolean equals(Object o) {

if (o == this)

return true;

if (o instanceof Map.Entry) {

Map.Entry\<?,?> e = (Map.Entry\<?,?>)o;

if (Objects.equals(key, e.getKey()) &&

Objects.equals(value, e.getValue()))

return true;

}

return false;

}

}

/**红黑树

* Entry for Tree bins. Extends LinkedHashMap.Entry (which in turn

* extends Node) so can be used as extension of either regular or

* linked node.

*/

static final class TreeNode\<K,V> extends LinkedHashMap.Entry\<K,V> {

TreeNode\<K,V> parent; // red-black tree links

TreeNode\<K,V> left;

TreeNode\<K,V> right;

TreeNode\<K,V> prev; // needed to unlink next upon deletion

boolean red;

TreeNode(int hash, K key, V val, Node\<K,V> next) {

super(hash, key, val, next);

}

/**

* Returns root of tree containing this node.

*/

final TreeNode\<K,V> root() {

for (TreeNode\<K,V> r = this, p;;) {

if ((p = r.parent) == null)

return r;

r = p;

}

}

......

}扩容

/** 为什么需要扩容:哈希冲突导致的链化影像查找效率,数组以空间换时间

由power-of-two expansion newCap = oldCap \<\< 1 可知扩容为原来的两倍

1010 十进制:10 原始数 number

10100 十进制:20 左移一位 number = number \<\< 1;

1010 十进制:10 右移一位 number = number >> 1;

即 oldCap \<\< 1 即二进制向左移动两位:oldCap \<\< 1=oldCap*2

同理oldCap >> 1=oldCap/2

补充>>>:无符号右移,忽略符号位,空位都以0补齐

* Initializes or doubles table size. If null, allocates in

* accord with initial capacity target held in field threshold.

* Otherwise, because we are using power-of-two expansion, the

* elements from each bin must either stay at same index, or move

* with a power of two offset in the new table.

*

* @return the table

*/

final Node\<K,V>[] resize() {

//oldTab扩容前哈希表

Node\<K,V>[] oldTab = table;

//扩容之前数组长度

int oldCap = (oldTab == null) ? 0 : oldTab.length;

//扩容之前的阈值,触发本次扩容的阈值

int oldThr = threshold;

//扩容之后的数组大小

//下次触发扩容的条件

int newCap, newThr = 0;

//散列表已初始化,这是一次正常的扩容

if (oldCap > 0) {

//扩容之前数组大小达到最大阈值,则不扩容且设扩容条件为int最大值

if (oldCap >= MAXIMUM_CAPACITY) {

threshold = Integer.MAX_VALUE;

return oldTab;

}

//oldCap左移一位实现数值翻倍,并且复制给newCap,newCap小于最大限制且扩容之前的数组长度 >= 16

else if ((newCap = oldCap \<\< 1) \< MAXIMUM_CAPACITY &&

oldCap >= DEFAULT_INITIAL_CAPACITY)

newThr = oldThr \<\< 1; // double threshold

}

//oldCap==0,说明HashMap中的散列表是null

//1.new HashMap(initCap,loadFactor);

//2.new HashMap(initCap);

//3.new HashMap(map);且map有数据

else if (oldThr > 0) // initial capacity was placed in threshold

newCap = oldThr;

//oldCap==0,oldThr==0

//new HashMap(map);

else { // zero initial threshold signifies using defaults

newCap = DEFAULT_INITIAL_CAPACITY;//16

newThr = (int)(DEFAULT_LOAD_FACTOR * DEFAULT_INITIAL_CAPACITY);//12

}

//newThr为0时,通过newCap和loadFactor计算出一个newThr

if (newThr == 0) {

float ft = (float)newCap * loadFactor;

newThr = (newCap \< MAXIMUM_CAPACITY && ft \< (float)MAXIMUM_CAPACITY ?

(int)ft : Integer.MAX_VALUE);

}

threshold = newThr;

//第一次或创建一个更大的数组

@SuppressWarnings({"rawtypes","unchecked"})

Node\<K,V>[] newTab = (Node\<K,V>[])new Node[newCap];

table = newTab;

//扩容前数组不为空

if (oldTab != null) {

for (int j = 0; j \< oldCap; ++j) {

//当前node节点

Node\<K,V> e;

//当前桶位中有数据,但是数据具体是单个数据或链表或红黑树还不明确

if ((e = oldTab[j]) != null) {

//方便JVM GC回收

oldTab[j] = null;

//当前节点为单数据

if (e.next == null)

newTab[e.hash & (newCap - 1)] = e;

//当前节点已经树化

else if (e instanceof TreeNode)

((TreeNode\<K,V>)e).split(this, newTab, j, oldCap);

//当前节点为链表

else { // preserve order

//loHead低位链表,存放在扩容之后的数组的下标位置,与当前数组的下标位置一致。

//hiHead高位链表,存放在扩容之后的数组的下标位置为当前数组的下标位置+扩容之前的长度。

Node\<K,V> loHead = null, loTail = null;

Node\<K,V> hiHead = null, hiTail = null;

Node\<K,V> next;

do {

next = e.next;

if ((e.hash & oldCap) == 0) {

if (loTail == null)

loHead = e;

else

loTail.next = e;

loTail = e;

}

else {

if (hiTail == null)

hiHead = e;

else

hiTail.next = e;

hiTail = e;

}

} while ((e = next) != null);

//低位链表有数据

if (loTail != null) {

loTail.next = null;

newTab[j] = loHead;

}

if (hiTail != null) {

hiTail.next = null;

newTab[j + oldCap] = hiHead;

}

}

}

}

}

return newTab;

}初始容量

/**默认(缺省)数组长度

* The default initial capacity - MUST be a power of two.

*/

static final int DEFAULT_INITIAL_CAPACITY = 1 \<\< 4; // aka 16

/**最大数组长度

* The maximum capacity, used if a higher value is implicitly specified

* by either of the constructors with arguments.

* MUST be a power of two \<= 1\<\<30.

*/

static final int MAXIMUM_CAPACITY = 1 \<\< 30;

/**缺省负载因子大小

* The load factor used when none specified in constructor.

*/

static final float DEFAULT_LOAD_FACTOR = 0.75f;

/**转换为红黑树的单个链表元素阈值

if (binCount >= TREEIFY_THRESHOLD - 1)

treeifyBin(tab, hash);看下面方法

}

* The bin count threshold for using a tree rather than list for a

* bin. Bins are converted to trees when adding an element to a

* bin with at least this many nodes. The value must be greater

* than 2 and should be at least 8 to mesh with assumptions in

* tree removal about conversion back to plain bins upon

* shrinkage.

*/

static final int TREEIFY_THRESHOLD = 8;

/**

* Replaces all linked nodes in bin at index for given hash unless

* table is too small, in which case resizes instead.

*/

final void treeifyBin(Node\<K,V>[] tab, int hash) {

int n, index; Node\<K,V> e;

if (tab == null || (n = tab.length) \< MIN_TREEIFY_CAPACITY)

resize();

else if ((e = tab[index = (n - 1) & hash]) != null) {

TreeNode\<K,V> hd = null, tl = null;

do {

TreeNode\<K,V> p = replacementTreeNode(e, null);

if (tl == null)

hd = p;

else {

p.prev = tl;

tl.next = p;

}

tl = p;

} while ((e = e.next) != null);

if ((tab[index] = hd) != null)

hd.treeify(tab);

}

}

/**从红黑树降为链表的阈值

* The bin count threshold for untreeifying a (split) bin during a

* resize operation. Should be less than TREEIFY_THRESHOLD, and at

* most 6 to mesh with shrinkage detection under removal.

*/

static final int UNTREEIFY_THRESHOLD = 6;

/**转换为红黑树的数组阈值

* The smallest table capacity for which bins may be treeified.

* (Otherwise the table is resized if too many nodes in a bin.)

* Should be at least 4 * TREEIFY_THRESHOLD to avoid conflicts

* between resizing and treeification thresholds.

*/

static final int MIN_TREEIFY_CAPACITY = 64;

/** 哈系桶(表)

* The table, initialized on first use, and resized as

* necessary. When allocated, length is always a power of two.

* (We also tolerate length zero in some operations to allow

* bootstrapping mechanics that are currently not needed.)

*/

transient Node\<K,V>[] table;

/**

* Holds cached entrySet(). Note that AbstractMap fields are used

* for keySet() and values().

*/

transient Set\<Map.Entry\<K,V>> entrySet;

/**当前哈希表元素个数

* The number of key-value mappings contained in this map.

*/

transient int size;

/**修改次数,不包含替换

* The number of times this HashMap has been structurally modified

* Structural modifications are those that change the number of mappings in

* the HashMap or otherwise modify its internal structure (e.g.,

* rehash). This field is used to make iterators on Collection-views of

* the HashMap fail-fast. (See ConcurrentModificationException).

*/

transient int modCount;

/**扩容阈值,当哈希表元素超过阈值时触发扩容,

* The next size value at which to resize (capacity * load factor).

*

* @serial

*/

// (The javadoc description is true upon serialization.

// Additionally, if the table array has not been allocated, this

// field holds the initial array capacity, or zero signifying

// DEFAULT_INITIAL_CAPACITY.)

int threshold;

/**负载因子,threshold = capacity * loadFactor

* The load factor for the hash table.

*

* @serial

*/

final float loadFactor;无序,可空

未解决问题:为什么有时候看起来有序? 答:

/**

* Associates the specified value with the specified key in this map.

* If the map previously contained a mapping for the key, the old

* value is replaced.

*

* @param key key with which the specified value is to be associated

* @param value value to be associated with the specified key

* @return the previous value associated with \<tt>key\</tt>, or

* \<tt>null\</tt> if there was no mapping for \<tt>key\</tt>.

* (A \<tt>null\</tt> return can also indicate that the map

* previously associated \<tt>null\</tt> with \<tt>key\</tt>.)

*/

public V put(K key, V value) {

return putVal(hash(key), key, value, false, true);

}

//====Key为null情况

//假设 putVal(hash(null), null, value, false, true);

//即 putVal(0, 0, value, false, true);

//由 if ((p = tab[i = (n - 1) & hash]) == null)

// tab[i] = newNode(hash, key, value, null);

//得tab[0]==null --> tab[0] = newNode(hash, key, value, null);

//key为null放在tab[0]

/**

* Computes key.hashCode() and spreads (XORs) higher bits of hash

* to lower. Because the table uses power-of-two masking, sets of

* hashes that vary only in bits above the current mask will

* always collide. (Among known examples are sets of Float keys

* holding consecutive whole numbers in small tables.) So we

* apply a transform that spreads the impact of higher bits

* downward. There is a tradeoff between speed, utility, and

* quality of bit-spreading. Because many common sets of hashes

* are already reasonably distributed (so don't benefit from

* spreading), and because we use trees to handle large sets of

* collisions in bins, we just XOR some shifted bits in the

* cheapest possible way to reduce systematic lossage, as well as

* to incorporate impact of the highest bits that would otherwise

* never be used in index calculations because of table bounds.

*/

//作用:在table长度不长的情况下,能让key的hash值的高16位也参与路由运算,

//异或:同0异1

//h=0b 0010 0101 1010 1100 0011 1111 0010 1110

// 0b 0010 0101 1010 1100 0011 1111 0010 1110

// ^

// 0b 0000 0000 0000 0000 0010 0101 1010 1100

//=> 0010 0101 1010 1100 0001 1010 1000 0010

static final int hash(Object key) {

int h;

return (key == null) ? 0 : (h = key.hashCode()) ^ (h >>> 16);

}

/**

* Implements Map.put and related methods

*

* @param hash hash for key

* @param key the key

* @param value the value to put

* onlyIfAbsent true==》key存在,不插入

* @param onlyIfAbsent if true, don't change existing value

* @param evict if false, the table is in creation mode.

* @return previous value, or null if none

*/

final V putVal(int hash, K key, V value, boolean onlyIfAbsent,

boolean evict) {

//tab 当前散列表

//p 当前散列表元素

//n 当前散列表数组长度

//i 路由寻址结果

Node\<K,V>[] tab; Node\<K,V> p; int n, i;

//延迟初始化,第一次调用putVal时会初始化hashMap对象中最消耗内存的散列表

if ((tab = table) == null || (n = tab.length) == 0)

n = (tab = resize()).length;

//最简单情况,寻址找到的桶位为null,直接放入数据

if ((p = tab[i = (n - 1) & hash]) == null)

tab[i] = newNode(hash, key, value, null);

else {

//e 不为null 找到了一个与当前要插入的key-value一致的 key元素

Node\<K,V> e; K k;

//表示桶位中的该元素与当前插入元素key完全一致,后续将替换

if (p.hash == hash &&

((k = p.key) == key || (key != null && key.equals(k))))

e = p;

//该元素已经树化时

else if (p instanceof TreeNode)

e = ((TreeNode\<K,V>)p).putTreeVal(this, tab, hash, key, value);

//链表时且不等于头元素,元素依次比较

else {

for (int binCount = 0; ; ++binCount) {

//最后一个元素还找不到同插入key相同的node

if ((e = p.next) == null) {

//插入最后

p.next = newNode(hash, key, value, null);

//链表元素数量大于8,树化

if (binCount >= TREEIFY_THRESHOLD - 1) // -1 for 1st

treeifyBin(tab, hash);

break;

}

//链表中找到同插入key的node,替换

if (e.hash == hash &&

((k = e.key) == key || (key != null && key.equals(k))))

break;

p = e;

}

}

//上面的e存在替换值

if (e != null) { // existing mapping for key

V oldValue = e.value;

if (!onlyIfAbsent || oldValue == null)

e.value = value;

afterNodeAccess(e);

return oldValue;

}

}

//记录修改次数,替换不算

++modCount;

//插入后容量大于扩容阈值则扩容

if (++size > threshold)

resize();

afterNodeInsertion(evict);

return null;

}GET()

/**

* Returns the value to which the specified key is mapped,

* or {@code null} if this map contains no mapping for the key.

*

* \<p>More formally, if this map contains a mapping from a key

* {@code k} to a value {@code v} such that {@code (key==null ? k==null :

* key.equals(k))}, then this method returns {@code v}; otherwise

* it returns {@code null}. (There can be at most one such mapping.)

*

* \<p>A return value of {@code null} does not \<i>necessarily\</i>

* indicate that the map contains no mapping for the key; it's also

* possible that the map explicitly maps the key to {@code null}.

* The {@link #containsKey containsKey} operation may be used to

* distinguish these two cases.

*

* @see #put(Object, Object)

*/

public V get(Object key) {

Node\<K,V> e;

return (e = getNode(hash(key), key)) == null ? null : e.value;

}

/**

* Implements Map.get and related methods.

*

* @param hash hash for key

* @param key the key

* @return the node, or null if none

*/

final Node\<K,V> getNode(int hash, Object key) {

//tab:引用当前 hashmap的散列表

//first:桶位中的头元素

//e:临时node元素

//n: table数组长度

Node\<K,V>[] tab; Node\<K,V> first, e; int n; K k;

if ((tab = table) != null && (n = tab.length) > 0 &&

(first = tab[(n - 1) & hash]) != null) {

//第一种情况:定位出来的桶位元素即为咱们要get的数据

if (first.hash == hash && // always check first node

((k = first.key) == key || (key != null && key.equals(k))))

return first;

//说明当前桶位不止一个元素,可能是链表也可能是红黑树

if ((e = first.next) != null) {

//第二种情况,桶升级成了红黑树

if (first instanceof TreeNode)

return ((TreeNode\<K,V>)first).getTreeNode(hash, key);

//桶形成了链表

do {

if (e.hash == hash &&

((k = e.key) == key || (key != null && key.equals(k))))

return e;

} while ((e = e.next) != null);

}

}

return null;

}Remove()

/**

* Implements Map.remove and related methods.

*

* @param hash hash for key

* @param key the key

* @param value the value to match if matchValue, else ignored

* @param matchValue if true only remove if value is equal

* @param movable if false do not move other nodes while removing

* @return the node, or null if none

*/

final Node\<K,V> removeNode(int hash, Object key, Object value,

boolean matchValue, boolean movable) {

//tab:引用当前 hashmap中的散列表

//p:当前node元素

//n:表示散列表数组长度

//index:表示寻址结果

Node\<K,V>[] tab; Node\<K,V> p; int n, index;

if ((tab = table) != null && (n = tab.length) > 0 &&

(p = tab[index = (n - 1) & hash]) != null) {

//说明路由的桶位是有数据的,需要进行查找操作,并且删除

//node:查找到的结果

//e:当前Node的下一个元素

Node\<K,V> node = null, e; K k; V v;

if (p.hash == hash &&

((k = p.key) == key || (key != null && key.equals(k))))

node = p;

else if ((e = p.next) != null) {

//说明,当前桶位要么是链表要么是红黑树

if (p instanceof TreeNode)//判断当前桶位是否升级为红黑树了

//第二种情况:红黑树查找

node = ((TreeNode\<K,V>)p).getTreeNode(hash, key);

else {

//第三种链表

do {

if (e.hash == hash &&

((k = e.key) == key ||

(key != null && key.equals(k)))) {

node = e;

break;

}

p = e;

} while ((e = e.next) != null);

}

}

//判断node不为空的话,说明按照key査找到需要删除的数据了

if (node != null && (!matchValue || (v = node.value) == value ||

(value != null && value.equals(v)))) {

//第一种情況:node是树节点,说明需要进行树节点移除操作

if (node instanceof TreeNode)

((TreeNode\<K,V>)node).removeTreeNode(this, tab, movable);

//第二种情況:桶位元素即为査找结果,则将该元素的下一个元素放至桶位中

else if (node == p)

tab[index] = node.next;

else

//第三种情況:将当前元素p的下一个元素设置成要删除元素的下一个元素

p.next = node.next;

++modCount;

--size;

afterNodeRemoval(node);

return node;

}

}

return null;

}构造方法

:>>>无符号右移,忽略符号位,空位都以0补齐

/* ---------------- Public operations -------------- */

/**

* Constructs an empty \<tt>HashMap\</tt> with the specified initial

* capacity and load factor.

*

* @param initialCapacity the initial capacity

* @param loadFactor the load factor

* @throws IllegalArgumentException if the initial capacity is negative

* or the load factor is nonpositive

*/

public HashMap(int initialCapacity, float loadFactor) {

//限制数组与loadFactor 0\<initialCapacity\<MAXIMUM_CAPACITY

// loadFactor>0

if (initialCapacity \< 0)

throw new IllegalArgumentException("Illegal initial capacity: " +

initialCapacity);

if (initialCapacity > MAXIMUM_CAPACITY)

initialCapacity = MAXIMUM_CAPACITY;

if (loadFactor \<= 0 || Float.isNaN(loadFactor))

throw new IllegalArgumentException("Illegal load factor: " +

loadFactor);

this.loadFactor = loadFactor;

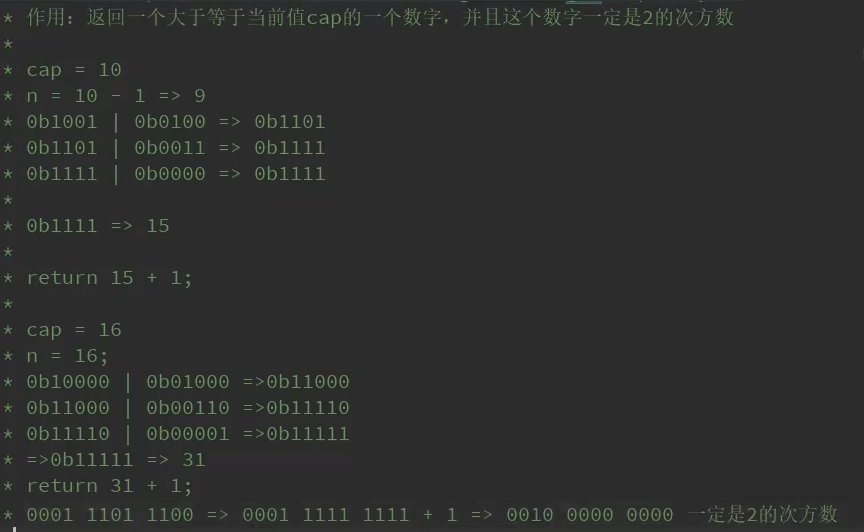

//tableSizeFor 返回一个大于等于当前cap的一个数字,并且这个数字一定是2的次方数,源码如下:

this.threshold = tableSizeFor(initialCapacity);

}

/**返回一个大于等于当前cap的一个数字,并且这个数字一定是2的次方数:

* >>>:无符号右移,忽略符号位,空位都以0补齐

* Returns a power of two size for the given target capacity.

*/

static final int tableSizeFor(int cap) {

int n = cap - 1;

n |= n >>> 1;

n |= n >>> 2;

n |= n >>> 4;

n |= n >>> 8;

n |= n >>> 16;

return (n \< 0) ? 1 : (n >= MAXIMUM_CAPACITY) ? MAXIMUM_CAPACITY : n + 1;

}

/**

* Constructs an empty \<tt>HashMap\</tt> with the specified initial

* capacity and the default load factor (0.75).

*

* @param initialCapacity the initial capacity.

* @throws IllegalArgumentException if the initial capacity is negative.

*/

public HashMap(int initialCapacity) {

this(initialCapacity, DEFAULT_LOAD_FACTOR);

}

/**

* Constructs an empty \<tt>HashMap\</tt> with the default initial capacity

* (16) and the default load factor (0.75).

*/

public HashMap() {

this.loadFactor = DEFAULT_LOAD_FACTOR; // all other fields defaulted

}

/**

* Constructs a new \<tt>HashMap\</tt> with the same mappings as the

* specified \<tt>Map\</tt>. The \<tt>HashMap\</tt> is created with

* default load factor (0.75) and an initial capacity sufficient to

* hold the mappings in the specified \<tt>Map\</tt>.

*

* @param m the map whose mappings are to be placed in this map

* @throws NullPointerException if the specified map is null

*/

public HashMap(Map\<? extends K, ? extends V> m) {

this.loadFactor = DEFAULT_LOAD_FACTOR;

putMapEntries(m, false);

}LinkedHashMap

| 特点 | 原因(源码) | |

|---|---|---|

| 底层哈希表+双向链表,HashMap子类 | 底层 | |

| 线程不安全 | 方法中没有synchronized | |

| 有序 | 有序 | |

| 多空键值或单空键或值 | 同HashMap | |

| 扩容两倍 | 同hashmap |

底层

put、resize扩容均使用HashMap的方法,拥有HashMap所有特性。

public class LinkedHashMap\<K,V>

extends HashMap\<K,V>

implements Map\<K,V>

{}

/**

* HashMap.Node subclass for normal LinkedHashMap entries.

*/

static class Entry\<K,V> extends HashMap.Node\<K,V> {

Entry\<K,V> before, after;

Entry(int hash, K key, V value, Node\<K,V> next) {

super(hash, key, value, next);

}

}

/**双向链表头

* The head (eldest) of the doubly linked list.

*/

transient LinkedHashMap.Entry\<K,V> head;

/**双向链表尾

* The tail (youngest) of the doubly linked list.

*/

transient LinkedHashMap.Entry\<K,V> tail;

/**

* The iteration ordering method for this linked hash map: \<tt>true\</tt>

* for access-order, \<tt>false\</tt> for insertion-order.

*

* @serial

*/

final boolean accessOrder;

/**

* Constructs an empty insertion-ordered \<tt>LinkedHashMap\</tt> instance

* with the specified initial capacity and a default load factor (0.75).

*

* @param initialCapacity the initial capacity

* @throws IllegalArgumentException if the initial capacity is negative

*/

public LinkedHashMap(int initialCapacity) {

super(initialCapacity);

accessOrder = false;

}

/**

* Constructs an empty insertion-ordered \<tt>LinkedHashMap\</tt> instance

* with the default initial capacity (16) and load factor (0.75).

*/

public LinkedHashMap() {

super();

accessOrder = false;

}

/**

* Constructs an insertion-ordered \<tt>LinkedHashMap\</tt> instance with

* the same mappings as the specified map. The \<tt>LinkedHashMap\</tt>

* instance is created with a default load factor (0.75) and an initial

* capacity sufficient to hold the mappings in the specified map.

*

* @param m the map whose mappings are to be placed in this map

* @throws NullPointerException if the specified map is null

*/

public LinkedHashMap(Map\<? extends K, ? extends V> m) {

super();

accessOrder = false;

putMapEntries(m, false);

}

/**

* Constructs an empty \<tt>LinkedHashMap\</tt> instance with the

* specified initial capacity, load factor and ordering mode.

*

* @param initialCapacity the initial capacity

* @param loadFactor the load factor

*=====此构造方法accessOrder为true时实现了按访问顺序存储元素======

*@param accessOrder the ordering mode - \<tt>true\</tt> for access-order, \<tt>false\</tt> for insertion-order

* @throws IllegalArgumentException if the initial capacity is negative

* or the load factor is nonpositive

*/

public LinkedHashMap(int initialCapacity,

float loadFactor,

boolean accessOrder) {

super(initialCapacity, loadFactor);

this.accessOrder = accessOrder;

}有序

/**

* HashMap.Node subclass for normal LinkedHashMap entries.

*/

static class Entry\<K,V> extends HashMap.Node\<K,V> {

//记录相邻两个key-value对象

Entry\<K,V> before, after;

Entry(int hash, K key, V value, Node\<K,V> next) {

super(hash, key, value, next);

}

}

/**双向链表头

* The head (eldest) of the doubly linked list.

*/

transient LinkedHashMap.Entry\<K,V> head;

/**双向链表尾

* The tail (youngest) of the doubly linked list.

*/

transient LinkedHashMap.Entry\<K,V> tail;

/**====false则按插入顺序存储元素,如果是true则按访问顺序存储元素

* The iteration ordering method for this linked hash map: \<tt>true\</tt>

* for access-order, \<tt>false\</tt> for insertion-order.

*

* @serial

*/

final boolean accessOrder;

Node\<K,V> newNode(int hash, K key, V value, Node\<K,V> e) {

LinkedHashMap.Entry\<K,V> p =

new LinkedHashMap.Entry\<K,V>(hash, key, value, e);

linkNodeLast(p);

return p;

}

/**

* The iteration ordering method for this linked hash map: \<tt>true\</tt>

* for access-order, \<tt>false\</tt> for insertion-order.

*

* @serial

*/

final boolean accessOrder;

// internal utilities

//实现有序的方法

//举例:放入1,2,3

//1进:head=tail=1 last=null

// 3进:tail=last=1--》tail=3 3.before=1 --》 1.after=3

// 2进:tail=last=3--》tail=2 2.before=3 --》 3.after=2

// link at the end of list

private void linkNodeLast(LinkedHashMap.Entry\<K,V> p) {

LinkedHashMap.Entry\<K,V> last = tail;

tail = p;

if (last == null)

head = p;

else {

p.before = last;

last.after = p;

}

}

//HashMap的Node===============

/**

* Basic hash bin node, used for most entries. (See below for

* TreeNode subclass, and in LinkedHashMap for its Entry subclass.)

*/

static class Node\<K,V> implements Map.Entry\<K,V> {

final int hash;

final K key;

V value;

Node\<K,V> next;

Node(int hash, K key, V value, Node\<K,V> next) {

this.hash = hash;

this.key = key;

this.value = value;

this.next = next;

}

public final K getKey() { return key; }

public final V getValue() { return value; }

public final String toString() { return key + "=" + value; }

public final int hashCode() {

return Objects.hashCode(key) ^ Objects.hashCode(value);

}

public final V setValue(V newValue) {

V oldValue = value;

value = newValue;

return oldValue;

}

public final boolean equals(Object o) {

if (o == this)

return true;

if (o instanceof Map.Entry) {

Map.Entry\<?,?> e = (Map.Entry\<?,?>)o;

if (Objects.equals(key, e.getKey()) &&

Objects.equals(value, e.getValue()))

return true;

}

return false;

}

}TreeMap

| 特点 | 原因(源码) | |

|---|---|---|

| 底层二叉树【红黑树】 | 底层红黑树 | |

| 线程不安全 | 方法中没有synchronized | |

| 有序,比较通过key | 底层红黑树 | |

| 多值可空 | ||

底层红黑树

//NavigableMap接口提供针对Key的有序访问,

public class TreeMap\<K,V>

extends AbstractMap\<K,V>

implements NavigableMap\<K,V>, Cloneable, java.io.Serializable

{

/**

* The comparator used to maintain order in this tree map, or

* null if it uses the natural ordering of its keys.

*

* @serial

*/

private final Comparator\<? super K> comparator;

private transient Entry\<K,V> root;

/**

* The number of entries in the tree

*/

private transient int size = 0;

/**

* The number of structural modifications to the tree.

*/

private transient int modCount = 0;

/**

* Node in the Tree. Doubles as a means to pass key-value pairs back to

* user (see Map.Entry).

*/

static final class Entry\<K,V> implements Map.Entry\<K,V> {

K key;

V value;

Entry\<K,V> left;

Entry\<K,V> right;

Entry\<K,V> parent;

boolean color = BLACK;

/**

* Make a new cell with given key, value, and parent, and with

* {@code null} child links, and BLACK color.

*/

Entry(K key, V value, Entry\<K,V> parent) {

this.key = key;

this.value = value;

this.parent = parent;

}

/**

* Returns the key.

*

* @return the key

*/

public K getKey() {

return key;

}

/**

* Returns the value associated with the key.

*

* @return the value associated with the key

*/

public V getValue() {

return value;

}

/**

* Replaces the value currently associated with the key with the given

* value.

*

* @return the value associated with the key before this method was

* called

*/

public V setValue(V value) {

V oldValue = this.value;

this.value = value;

return oldValue;

}

public boolean equals(Object o) {

if (!(o instanceof Map.Entry))

return false;

Map.Entry\<?,?> e = (Map.Entry\<?,?>)o;

return valEquals(key,e.getKey()) && valEquals(value,e.getValue());

}

public int hashCode() {

int keyHash = (key==null ? 0 : key.hashCode());

int valueHash = (value==null ? 0 : value.hashCode());

return keyHash ^ valueHash;

}

public String toString() {

return key + "=" + value;

}

}}HashTable

线程安全,内部的方法基本都经过 synchronized,保留类不建议使用

ConcurrentHashMap

| 特点 | 原因(源码) | |

|---|---|---|

| 底层数组、链表、红黑树 | 底层 | |

| 线程安全 | 线程安全 | |

| 动态扩容为原来的2倍 | int newCapacity = oldCapacity + ((capacityIncrement > 0) ? capacityIncrement : oldCapacity); | |

| 都安全但是ConcurrentHashMap 比 HashTable 效率要高 | ConcurrentHashMap 锁粒度更细 | |

| 非空 |

JDK1.7 : 【数组(Segment) + 数组(HashEntry) + 链表(HashEntry节点)】

ConcurrentHashMap(分段锁) 对整个桶数组进行了分割分段(Segment),每一把锁只锁容器其中一部分数据,多线程访问容器里不同数据段的数据,就不会存在锁竞争,提高并发访问率。Segment是一种可重入锁ReentrantLock,在ConcurrentHashMap里扮演锁的角色,HashEntry则用于存储键值对数据。

JDK1.8 : Node数组+链表 / 红黑树

利用CAS+Synchronized来保证并发更新的安全,底层依然采用数组+链表+红黑树的存储结构。

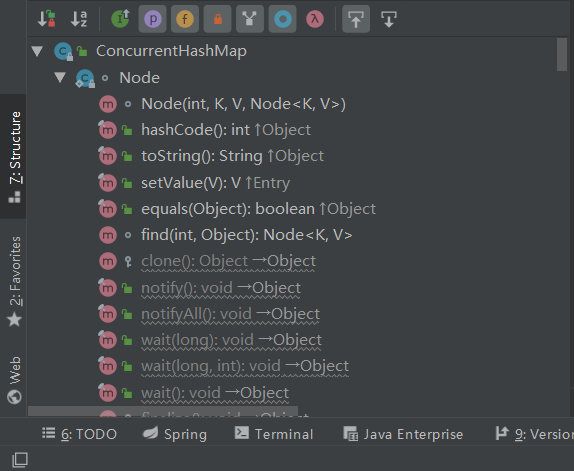

底层

/**

* The array of bins. Lazily initialized upon first insertion.

* Size is always a power of two. Accessed directly by iterators.

*/

transient volatile Node\<K,V>[] table;

/**

* The next table to use; non-null only while resizing.

*/

private transient volatile Node\<K,V>[] nextTable;

/**

* Base counter value, used mainly when there is no contention,

* but also as a fallback during table initialization

* races. Updated via CAS.

*/

private transient volatile long baseCount;

/**

* hash表初始化或扩容时的一个控制位标识量。

* 负数代表正在进行初始化或扩容操作

* -1代表正在初始化

* -N 表示有N-1个线程正在进行扩容操作

* 正数或0代表hash表还没有被初始化,这个数值表示初始化或下一次进行扩容的大小

* Table initialization and resizing control. When negative, the

* table is being initialized or resized: -1 for initialization,

* else -(1 + the number of active resizing threads). Otherwise,

* when table is null, holds the initial table size to use upon

* creation, or 0 for default. After initialization, holds the

* next element count value upon which to resize the table.

*/

private transient volatile int sizeCtl;

/**

* The next table index (plus one) to split while resizing.

*/

private transient volatile int transferIndex;

/**

* Spinlock (locked via CAS) used when resizing and/or creating CounterCells.

*/

private transient volatile int cellsBusy;

/**

* Table of counter cells. When non-null, size is a power of 2.

*/

private transient volatile CounterCell[] counterCells;Queue

先进先出

PriorityQueue

| 特点 | 原因(源码) | |

|---|---|---|

| 底层二叉小顶堆 | ||

| 保证每次取出的元素是队列中权值最小的 | 方法中有synchronized,所以性能不如ArrayList | |

| 非null | int newCapacity = oldCapacity + ((capacityIncrement > 0) ? capacityIncrement : oldCapacity); | |

工具类

Collections

确保内容不被修改

- unmodifiableMap

- unmodifiableList

- unmodifiableSet

Arrays

Comparable和Comparator

Comparable是排序接口;若一个类实现了Comparable接口,就意味着“该类支持排序”。而Comparator是比较器;我们若需要控制某个类的次序,可以建立一个“该类的比较器”来进行排序。Comparable相当于“内部比较器”,而Comparator相当于“外部比较器”。

容器综合问题

JUC

问题:什么时候该用多线程?

在Java中,线程部分是一个重点,本篇文章说的JUC也是关于线程的。JUC就是java.util .concurrent工具包的简称。这是一个处理线程的工具包,JDK 1.5开始出现的。

多线程基础

进程(Process)

把一个任务称为一个进程

- 进程内部还需要同时执行多个子任务称为线程

进程和线程的关系就是:一个进程可以包含一个或多个线程(Thread),但至少会有一个线程。

多进程模式(每个进程只有一个线程)

多线程模式(一个进程有多个线程)

多进程+多线程模式(复杂度最高)

和多线程相比,

多进程缺点在于:创建进程比创建线程开销大,尤其是在Windows系统上;进程间通信比线程间通信要慢,因为线程间通信就是读写同一个变量,速度很快。

多进程的优点在于:多进程稳定性比多线程高,因为在多进程的情况下,一个进程崩溃不会影响其他进程,而在多线程的情况下,任何一个线程崩溃会直接导致整个进程崩溃。多线程

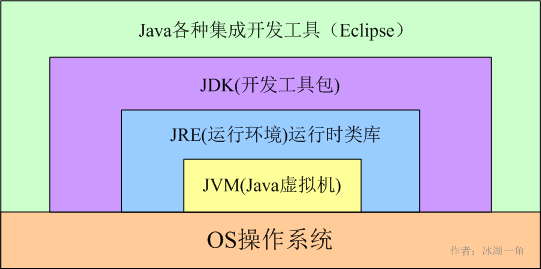

- Java语言内置了多线程支持:一个Java程序实际上是一个JVM进程,JVM进程用一个主线程来执行main()方法,在main()方法内部,我们又可以启动多个线程。此外,JVM还有负责垃圾回收的其他工作线程等。

因此,对于大多数Java程序来说,我们说多任务,实际上是说如何使用多线程实现多任务。

和单线程相比,多线程编程的特点在于:多线程经常需要读写共享数据,并且需要同步。例如,播放电影时,就必须由一个线程播放视频,另一个线程播放音频,两个线程需要协调运行,否则画面和声音就不同步。因此,多线程编程的复杂度高,调试更困难。

Java多线程编程的特点又在于:多线程模型是Java程序最基本的并发模型;后续读写网络、数据库、Web开发等都依赖Java多线程模型。

管程

管程(monitor)是保证了同一时刻只有一个进程在管程内活动,即管程内定义的操作在同一时刻只被一个进程调用(由编译器实现).但是这样并不能保证进程以设计的顺序执行。JVM中同步是基于进入和退出管程(monitor)对象实现的,每个对象都会有一个管程(monitor)对象,管程(monitor)会随着java对象一同创建和销毁。执行线程首先要持有管程对象,然后才能执行方法,当方法完成之后会释放管程,方法在执行时候会持有管程,其他线程无法再获取同一个管程

显式创建新线程

- 继承Thread类,实例化一个Thread实例并重写run(),然后调用它的start()方法:

希望新线程能执行指定的代码

- 方法一:从Thread派生一个自定义类,然后覆写run()方法:

- 方法二:创建Thread实例时,传入一个Runnable实例:

- 线程的优先级

可以对线程设定优先级,设定优先级的方法是:

Thread.setPriority(int n) // 1~10, 默认值5

- 实现Runnable接口

- 与Callable不同

- 无返回值

- 无返回异常

- 实现run()

- 实现Callable接口(jdk1.5)

- 实现 Callable接口

1.实现 Callable接口,需要返回值类型

2.重写call方法,需要抛出异常

3.创建目标对象

4.创建执行服务: Executorservice ser= Executors. newfixed Threadpool(1)

5.提交执行: Future< Boolean> result1=ser. submit(t1);

6.获取结果: boolean r1= result1.get()

7.关闭服务:ser. shutdownNow()

- 实现 Callable接口

总结:Thread为基,另外两个通过Thread 实例实现,通过接口避免单继承局限性,灵活方便同一个对象被多个线程使用,区别在Callable 有返回值,返回值通过FutureTask封装再给Thread实例,而Runnable实例直接给Thread 实例实现。

package pers.lxl.mylearnproject.javase.thread;

import java.util.concurrent.Callable;

import java.util.concurrent.ExecutionException;

import java.util.concurrent.FutureTask;

/**

* 快速交替执行看起来像是同时执行

* 进程和线程的关系:一个进程可以包含一个或多个线程,但至少会有一个线程

* 多进程模式(每个进程只有一个线程)

* 多线程模式(一个进程有多个线程)

* 多进程+多线程模式(复杂度最高)

* 和多线程相比,多进程的缺点在于:

* 创建进程比创建线程开销大,尤其是在Windows系统上;

* 进程间通信比线程间通信要慢,因为线程间通信就是读写同一个变量,速度很快。

* 多进程的优点在于:

* 多进程稳定性比多线程高,因为在多进程的情况下,一个进程崩溃不会影响其他进程,而在多线程的情况下,任何一个线程崩溃会直接导致整个进程崩溃。

* Java语言内置了多线程支持:一个Java程序实际上是一个JVM进程,JVM进程用一个主线程来执行main()方法,在main()方法内部,我们又可以启动多个线程。此外,JVM还有负责垃圾回收的其他工作线程等。

* 因此,对于大多数Java程序来说,我们说多任务,实际上是说如何使用多线程实现多任务。

* 和单线程相比,多线程编程的特点在于:多线程经常需要读写共享数据,并且需要同步。例如,播放电影时,就必须由一个线程播放视频,另一个线程播放音频,两个线程需要协调运行,否则画面和声音就不同步。因此,多线程编程的复杂度高,调试更困难。

* Java多线程编程的特点又在于:

* 多线程模型是Java程序最基本的并发模型;

* 后续读写网络、数据库、Web开发等都依赖Java多线程模型。

*

* @author lxl

**/

public class HelloClass {

//希望新线程能执行指定的代码,有以下几种方法:

/**

* 方法一:从Thread派生一个自定义类,然后覆写run()方法,启动:子类对象.start(),为避免OOP单继承局限性,不建议使用

*/

static class MyThread extends Thread {

@Override

public void run() {

System.out.println("start new thread!extends Thread");

}

}

/**

* 方法二:创建Thread实例时,传入一个Runnable实例:启动:传入目标对象+Thread对象.start(),建议使用:避免单继承局限性,灵活方便同一个对象被多个线程使用

*/

static class MyRunnable implements Runnable {

@Override

public void run() {

System.out.println("start new thread!implements Runnable");

try {

Thread.sleep(10);

} catch (InterruptedException e) {

}

System.out.println("thread end.");

}

}

/**

* 方法三:实现Callable接口,与Runnable相比,Callable可以有返回值,返回值通过FutureTask【未来任务】进行封装

*/

static class MyCallable implements Callable\<Integer> {

@Override

public Integer call() {

return 123;

}

}

//相比之下,接口可以实现多个,而Thread只能单继承,

// 继承整个Threa类开销过大,所以实现接口方式更好一些

/**

* 当Java程序启动的时候,实际上是启动了一个JVM进程,然后,JVM启动主线程来执行main()方法。在main()方法中,我们又可以启动其他线程。

*/

public static void main(String[] args) throws ExecutionException, InterruptedException {

//创建新线程

System.out.println("main start...");

//Thread thread = new Thread();//不能执行指定代码

//extends Thread==============

// Thread thread = new MyThread();

//implements Callable=============

MyCallable mc = new MyCallable();

FutureTask\<Integer> ft = new FutureTask\<>(mc);

Thread thread1 = new Thread(ft);

thread1.start();

System.out.println(ft.get());

//lambda Callbale

FutureTask\<Integer> futureTask2 = new FutureTask\<>(()->{

System.out.println(Thread.currentThread().getName()+"come in callbale");

return 111;

});

new thread(futureTask2,"hahha").start();//hahha come in callbale

while(!futuretask2.isDone()){

System.out.println("wait....")

}

System.out.println(futureTask2.get());//111

//implements Runnable===============

Thread thread = new Thread(new MyRunnable());

//Thread thread = new Thread(() -> {System.out.println("start new thread!"); });//Java8引入的lambda写法

thread.start();// 启动新线程,直接调用Thread实例的run()方法是无效的,线程开启不一定立即执行,由CPU调度决定

// Thread.setPriority(int n) // 1~10, 默认值5

try {

Thread.sleep(20);

// sleep() 可能会抛出 InterruptedException,因为异常不能跨线程传播回 main() 中,因此必须在本地进行处理。线程中抛出的其它异常也同样需要在本地进行处理。

} catch (InterruptedException e) {

}

System.out.println("main end...");

}

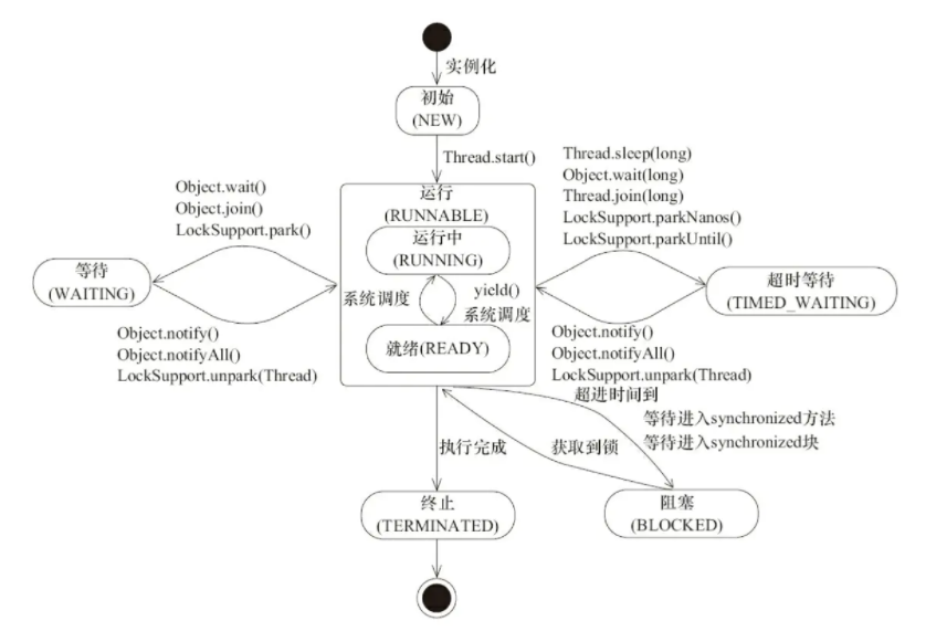

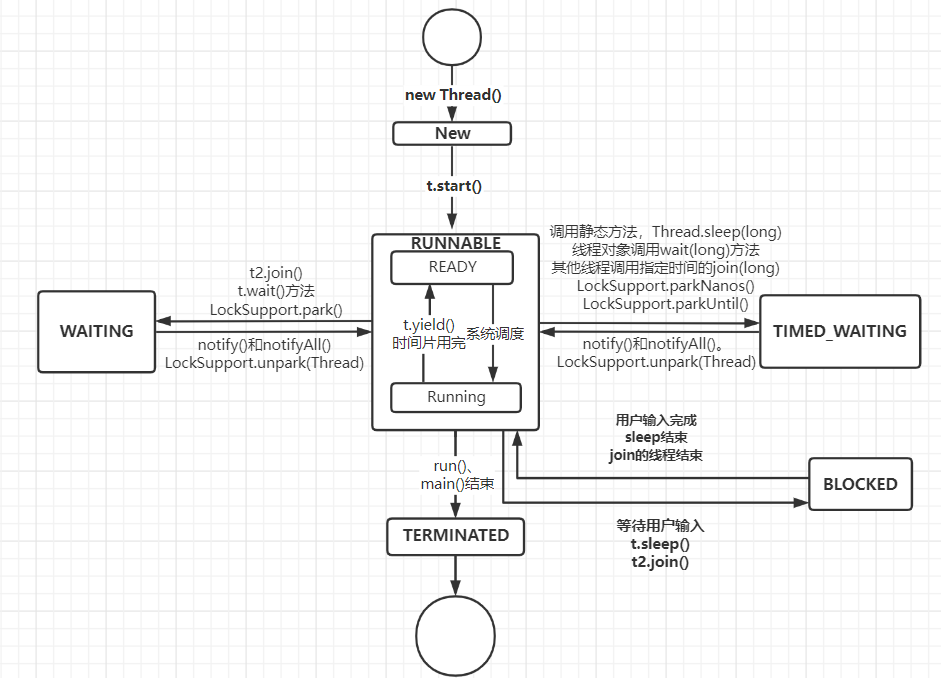

}线程的状态

- 在Java程序中,一个线程对象只能调用一次start()方法启动新线程,并在新线程中执行run()方法。一旦run()方法执行完毕,线程就结束了。因此,Java线程的状态有以下几种:

New:新创建的线程,尚未执行;

Runnable:运行中的线程,正在执行run()方法的Java代码;

Blocked:运行中的线程,因为某些操作被阻塞而挂起;

Waiting(不见不散):运行中的线程,因为某些操作在等待中;

Timed Waiting(过时不候):运行中的线程,因为执行sleep()方法正在计时等待;

Terminated:线程已终止,因为run()方法执行完毕。

- 线程终止的原因有:

线程正常终止:run()方法执行到return语句返回;

线程意外终止:run()方法因为未捕获的异常导致线程终止;

对某个线程的Thread实例调用stop()方法强制终止(强烈不推荐使用)。

- 通过对另一个线程对象调用join()方法可以等待其执行结束;

可以指定等待时间,超过等待时间线程仍然没有结束就不再等待;

对已经运行结束的线程调用join()方法会立刻返回。

中断线程

- 对目标线程调用interrupt()方法可以请求中断一个线程,目标线程通过检测isInterrupted()标志获取自身是否已中断。如果目标线程处于等待状态,该线程会捕获到InterruptedException;

目标线程检测到isInterrupted()为true或者捕获了InterruptedException都应该立刻结束自身线程;

通过标志位判断需要正确使用volatile关键字;

volatile关键字解决了共享变量在线程间的可见性问题。

- 对目标线程调用interrupt()方法可以请求中断一个线程,目标线程通过检测isInterrupted()标志获取自身是否已中断。如果目标线程处于等待状态,该线程会捕获到InterruptedException;

线程属性

线程优先级

- setPriority

守护线程

守护线程是指为其他线程服务的线程。在JVM中,所有非守护线程都执行完毕后,无论有没有守护线程,虚拟机都会自动退出。因此,JVM退出时,不必关心守护线程是否已结束。如何创建守护线程呢?方法和普通线程一样,只是在调用start()方法前,调用setDaemon(true)把该线程标记为守护线程:

守护线程不能持有任何需要关闭的资源,例如打开文件等,因为虚拟机退出时,守护线程没有任何机会来关闭文件,这会导致数据丢失。

应用:JVM垃圾回收、事件监听、心跳监测

Thread t = new MyThread(); //调用start()方法前,调用setDaemon(true)把该线程标记为守护线程 t.setDaemon(true); //守护线程不能持有任何需要关闭的资源,例如打开文件等,因为虚拟机退出时,守护线程没有任何机会来关闭文件,这会导致数据丢失。 t.start(); //判断是否为守护线程 System.out.println(t.isDaemon());

线程组

处理未捕获异常处理器

多线程编程步骤

- 创建资源类,在资源类创建属性和操作方法

- 在资源类中添加操作方法【判断、干活、通知】

- 创建多个线程,调用资源类的操作方法

synchronized

synchronized是Java中的关键字,是一种同步锁。它修饰的对象有以下几种:

- 修饰一个代码块,被修饰的代码块称为同步语句块,其作用的范围是大括号{}括起来的代码,作用的对象是调用这个代码块的对象;

- 修饰一个方法,被修饰的方法称为同步方法,其作用的范围是整个方法,作用的对象是调用这个方法的对象;虽然可以使用synchronized来定义方法,但synchronized并不属于方法定义的一部分,因此,synchronized关键字不能被继承。如果在父类中的某个方法使用了synchronized关键字,而在子类中覆盖了这个方法,在子类中的这个方法默认情况下并不是同步的,而必须显式地在子类的这个方法中加上synchronized关键字才可以。当然,还可以在子类方法中调用父类中相应的方法,这样虽然子类中的方法不是同步的,但子类调用了父类的同步方法,因此,子类的方法也就相当于同步了。

- 修饰一个静态的方法,其作用的范围是整个静态方法,作用的对象是这个类的所有对象;

- 修饰一个类,其作用的范围是synchronized后面括号括起来的部分,作用主的对象是这个类的所有对象。

一个对象里面如果有多个synchronized方法,某一个时刻内,只要一个线程去调用其中的一个synchronized方法了,其它的线程都只能等待,换句话说,某一个时刻内,只能有唯一一个线程去访问这些synchronized方法,锁的是当前对象this,被锁定后,其它的线程都不能进入到当前对象的其它的synchronized方法,加个普通方法后发现和同步锁无关,换成两个对象后,不是同一把锁了,情况立刻变化。

synchronized实现同步的基础:Java中的每一个对象都可以作为锁。

具体表现为以下3种形式。

对于普通同步方法,锁是当前实例对象。

对于静态同步方法,锁是当前类的Class对象。

对于同步方法块,锁是Synchonized括号里配置的对象

当一个线程试图访问同步代码块时,它首先必须得到锁,退出或抛出异常时必须释放锁。也就是说如果一个实例对象的非静态同步方法获取锁后,该实例对象的其他非静态同步方法必须等待获取锁的方法释放锁后才能获取锁,可是别的实例对象的非静态同步方法因为跟该实例对象的非静态同步方法用的是不同的锁,所以毋须等待该实例对象已获取锁的非静态同步方法释放锁就可以获取他们自己的锁。所有的静态同步方法用的也是同一把锁——类对象本身,这两把锁是两个不同的对象,所以静态同步方法与非静态同步方法之间是不会有竞态条件的。

但是一旦一个静态同步方法获取锁后,其他的静态同步方法都必须等待该方法释放锁后才能获取锁,而不管是同一个实例对象的静态同步方法之间,还是不同的实例对象的静态同步方法之间,只要它们同一个类的实例对象!

线程同步

- 多线程同时读写共享变量时,会造成逻辑错误,因此需要通过synchronized同步;同步的本质就是给指定对象加锁,加锁后才能继续执行后续代码;注意加锁对象必须是同一个实例;对JVM定义的单个原子操作不需要同步。

同步方法

- 用synchronized修饰方法可以把整个方法变为同步代码块,synchronized方法加锁对象是this;

通过合理的设计和数据封装可以让一个类变为“线程安全”;

一个类没有特殊说明,默认不是thread-safe;

多线程能否安全访问某个非线程安全的实例,需要具体问题具体分析。

死锁

- Java的synchronized锁是隐式【自动上锁解锁】的可重入锁(递归锁),Lock是显式的可重入锁;死锁产生的条件是多线程各自持有不同的锁,并互相试图获取对方已持有的锁,导致无限等待;避免死锁的方法是多线程获取锁的顺序要一致。

package com.atguigu.sync;

import java.util.concurrent.TimeUnit;

/**

* 演示死锁

*/

public class DeadLock {

//创建两个对象

static Object a = new Object();

static Object b = new Object();

public static void main(String[] args) {

new Thread(()->{

synchronized (a) {

System.out.println(Thread.currentThread().getName()+" 持有锁a,试图获取锁b");

try {

TimeUnit.SECONDS.sleep(1);

} catch (InterruptedException e) {

e.printStackTrace();

}

synchronized (b) {

System.out.println(Thread.currentThread().getName()+" 获取锁b");

}

}

},"A").start();

new Thread(()->{

synchronized (b) {

System.out.println(Thread.currentThread().getName()+" 持有锁b,试图获取锁a");

try {

TimeUnit.SECONDS.sleep(1);

} catch (InterruptedException e) {

e.printStackTrace();

}

synchronized (a) {

System.out.println(Thread.currentThread().getName()+" 获取锁a");

}

}

},"B").start();

}

}验证是否为死锁

配置JDK环境变量

项目中打开终端

输入jps -l 查看当前类的进程号

jstack -进程号可查看是否有死锁及相关信息

使用wait和notify

wait和notify用于多线程协调运行:

在synchronized内部可以调用wait()使线程进入等待状态;

必须在已获得的锁对象上调用wait()方法;

在synchronized内部可以调用notify()或notifyAll()唤醒其他等待线程;

必须在已获得的锁对象上调用notify()或notifyAll()方法;

已唤醒的线程还需要重新获得锁后才能继续执行。虚假唤醒

wait()在哪里睡就在那里醒使用时应使用while而不是if

if(num!=1){ this.wait(); //notifyAll()唤醒之后会直接从this.wait()语句开始执行,跳过了if判断 } while(num!=1){ this.wait(); }

使用ReentrantLock

- ReentrantLock可以替代synchronized进行同步;

ReentrantLock获取锁更安全;

必须先获取到锁,再进入try {...}代码块,最后使用finally保证释放锁;

可以使用tryLock()尝试获取锁。

设置为ReentrantLock(true)使其成为公平锁

Lock lock = new ReentrantLock();

Thread t1 = new Thread() {

@Override

public void run() {

try {

log("线程启动");

log("试图占有对象:lock");

//lock同步

lock.lock();

log("占有对象:lock");

log("进行5秒的业务操作");

Thread.sleep(5000);

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

log("释放对象:lock");

//手动释放

lock.unlock();

}

log("线程结束");

}

};

t1.setName("t1");

t1.start();使用Condition

- Condition可以替代wait和notify;

Condition对象必须从Lock对象获取。

private Lock lock=new ReentrantLock();

private Condition condition=lock.newCondition();锁

一种设计思想、不同环境使用不同的锁以达到资源最优利用。

乐观锁 VS 悲观锁

悲观锁先加锁再操作资源,乐观锁直接操作资源。

为何乐观锁能够做到不锁定同步资源也可以正确的实现线程同步呢?我们通过介绍乐观锁的主要实现方式 “CAS” 的技术原理来为大家解惑。

CAS全称 Compare And Swap(比较与交换),是一种无锁算法。在不使用锁(没有线程被阻塞)的情况下实现多线程之间的变量同步。java.util.concurrent包中的原子类就是通过CAS来实现了乐观锁。

CAS算法涉及到三个操作数:

- 需要读写的内存值 V。

- 进行比较的值 A。

- 要写入的新值 B。

当且仅当 V 的值等于 A 时,CAS通过原子方式用新值B来更新V的值(“比较+更新”整体是一个原子操作),否则不会执行任何操作。一般情况下,“更新”是一个不断重试的操作。

CAS问题:

ABA问题

。CAS需要在操作值的时候检查内存值是否发生变化,没有发生变化才会更新内存值。但是如果内存值原来是A,后来变成了B,然后又变成了A,那么CAS进行检查时会发现值没有发生变化,但是实际上是有变化的。ABA问题的解决思路就是在变量前面添加版本号,每次变量更新的时候都把版本号加一,这样变化过程就从“A-B-A”变成了“1A-2B-3A”。

- JDK从1.5开始提供了AtomicStampedReference类来解决ABA问题,具体操作封装在compareAndSet()中。compareAndSet()首先检查当前引用和当前标志与预期引用和预期标志是否相等,如果都相等,则以原子方式将引用值和标志的值设置为给定的更新值。

循环时间长开销大。CAS操作如果长时间不成功,会导致其一直自旋,给CPU带来非常大的开销。

只能保证一个共享变量的原子操作

对一个共享变量执行操作时,CAS能够保证原子操作,但是对多个共享变量操作时,CAS是无法保证操作的原子性的。

Java从1.5开始JDK提供了AtomicReference类来保证引用对象之间的原子性,可以把多个变量放在一个对象里来进行CAS操作。

自旋锁 VS 适应性自旋锁

自旋锁不放弃CPU时间片,自旋等待锁释放,如果自旋超过了限定次数(默认是10次,可以使用-XX:PreBlockSpin来更改)没有成功获得锁,就应当挂起线程。

适应性自旋锁的自适应意味着自旋的时间(次数)不再固定,而是由前一次在同一个锁上的自旋时间及锁的拥有者的状态来决定。如果在同一个锁对象上,自旋等待刚刚成功获得过锁,并且持有锁的线程正在运行中,那么虚拟机就会认为这次自旋也是很有可能再次成功,进而它将允许自旋等待持续相对更长的时间。如果对于某个锁,自旋很少成功获得过,那在以后尝试获取这个锁时将可能省略掉自旋过程,直接阻塞线程,避免浪费处理器资源。在自旋锁中 另有三种常见的锁形式:TicketLock、CLHlock和MCSlock

无锁 VS 偏向锁 VS 轻量级锁 VS 重量级锁

无锁,没有对资源进行锁定,所有的线程都能访问并修改同一个资源,但同时只有一个线程能修改成功。

偏向锁,一段代码一直被一个线程访问,那么该线程会自动获取锁,降低获取锁的代价。

偏向锁时,被另外的线程所访问,偏向锁就会升级为轻量级锁,其他线程会通过自旋的形式尝试获取锁,不会阻塞,从而提高性能。

若当前只有一个等待线程,则该线程通过自旋进行等待。但是当自旋超过一定的次数,或者一个线程在持有锁,一个在自旋,又有第三个来访时(或轻量级锁时有第三者),轻量级锁升级为重量级锁。

公平锁 VS 非公平锁

公平锁通过申请锁的顺序来获取锁

非公平锁直接获取锁,获取不到会到等待队列末尾等待,节约唤起线程的开销,提高吞吐率,但是部分线程可能会被饿死,或等待时间很长。

可重入锁 VS 非可重入锁

可重入锁(递归锁),是指在同一个线程在外层方法获取锁的时候,再进入该线程的内层方法会自动获取锁(前提锁对象得是同一个对象或者class),不会因为之前已经获取过还没释放而阻塞。

非可重入锁,反之同线程在外层获取锁时在进入内层需要先释放锁,重复调用同步数据时可能会导致死锁。

独享锁 VS 共享锁

独享锁(排他锁),该锁一次只能被一个线程拥有,加锁后不能再加其他锁,线程拥有后可读与改。

共享锁,该锁能被多个线程所拥有的,拥有后只能读不可改,其他线程可以加共享锁不能加独享锁(排它锁)。

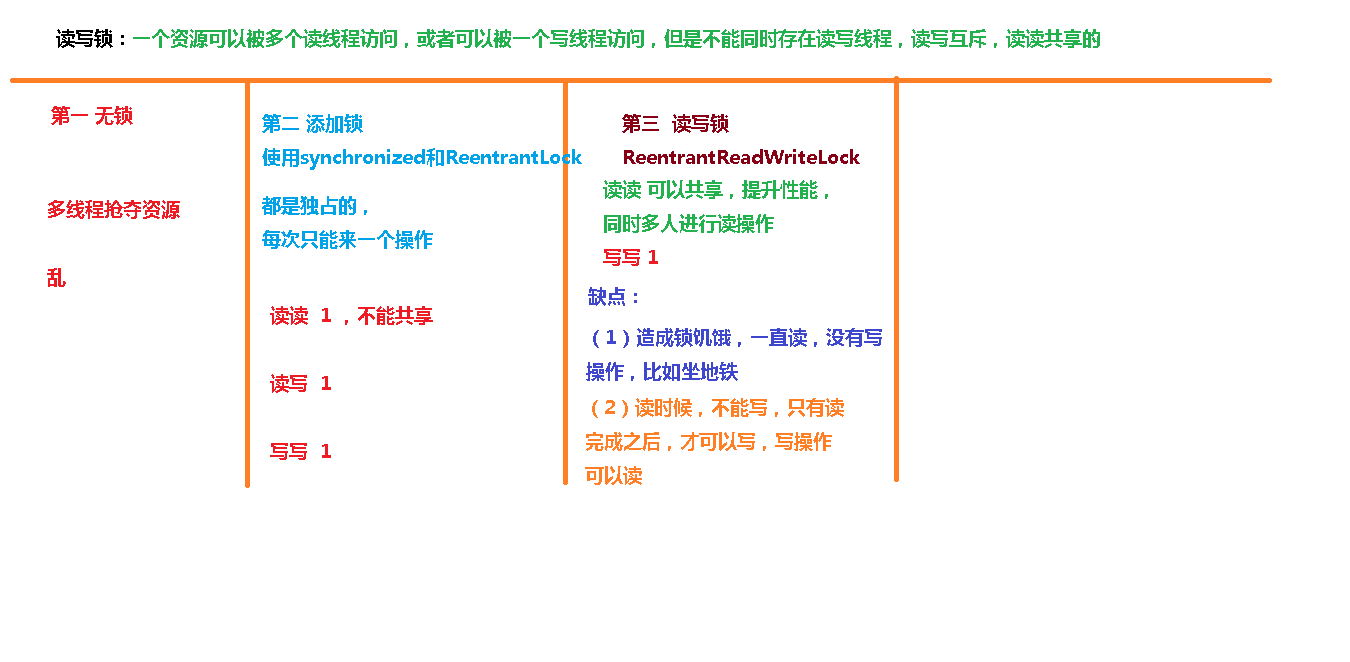

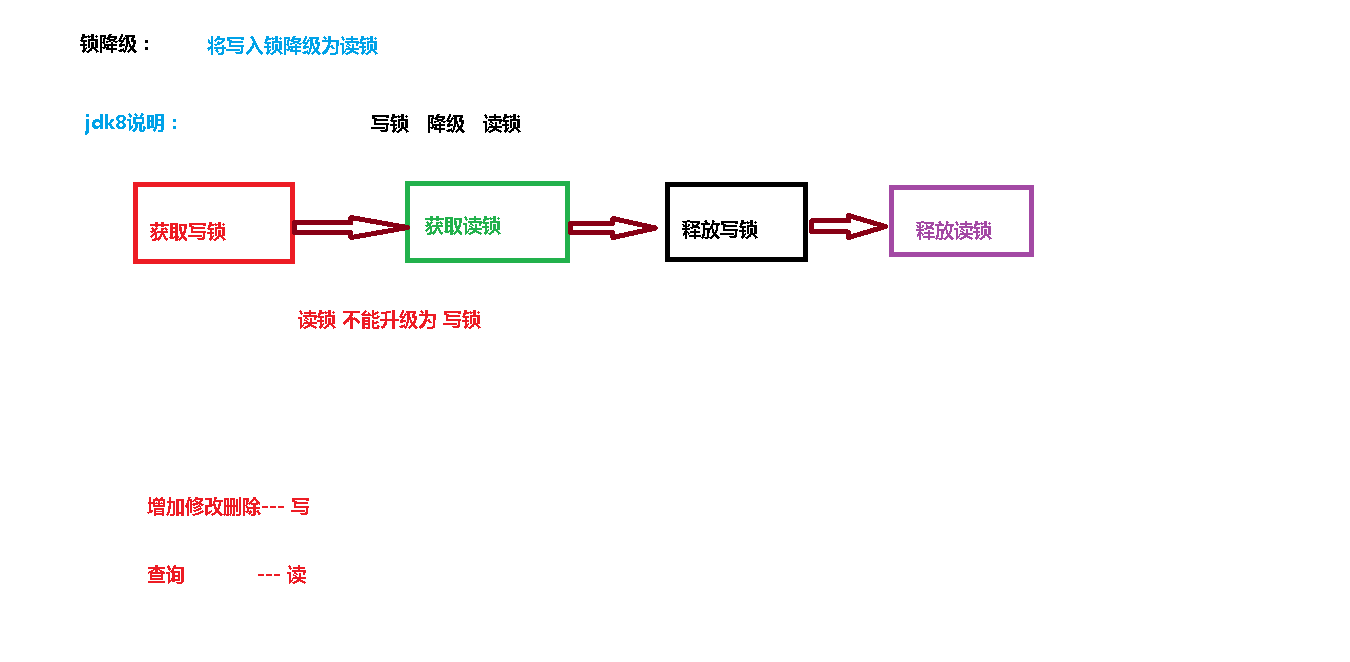

读锁写锁

ReentrantReadWriteLock 里的两把锁 ReadLock 和 WriteLock,读锁是共享锁,写锁是独享锁,都会发生死锁。

现实中有这样一种场景:对共享资源有读和写的操作,且写操作没有读操作那么频繁。在没有写操作的时候,多个线程同时读一个资源没有任何问题,所以应该允许多个线程同时读取共享资源;但是如果一个线程想去写这些共享资源,就不应该允许其他线程对该资源进行读和写的操作了。

针对这种场景,JAVA的并发包提供了读写锁ReentrantReadWriteLock,它表示两个锁,一个是读操作相关的锁,称为共享锁;一个是写相关的锁,称为排他锁

- 线程进入读锁的前提条件:

• 没有其他线程的写锁

• 没有写请求, 或者有写请求,但调用线程和持有锁的线程是同一个(可重入锁)。 - 线程进入写锁的前提条件:

• 没有其他线程的读锁

• 没有其他线程的写锁

而读写锁有以下三个重要的特性:

(1)公平选择性:支持非公平(默认)和公平的锁获取方式,吞吐量还是非公平优于公平。

(2)重进入:读锁和写锁都支持线程重进入。

(3)锁降级:遵循获取写锁、获取读锁再释放写锁的次序,写锁能够降级成为读锁。

表锁行锁

表锁整张表,而行锁锁单条数据且可能发生死锁。

使用ReadWriteLock

- 使用ReadWriteLock可以提高读取效率:

ReadWriteLock只允许一个线程写入;

ReadWriteLock允许多个线程在没有写入时同时读取;

ReadWriteLock适合读多写少的场景。

package com.atguigu.readwrite;

import java.util.HashMap;

import java.util.Map;

import java.util.concurrent.TimeUnit;

import java.util.concurrent.locks.Lock;

import java.util.concurrent.locks.ReadWriteLock;

import java.util.concurrent.locks.ReentrantReadWriteLock;

//资源类

class MyCache {

//创建map集合

private volatile Map\<String,Object> map = new HashMap\<>();

//创建读写锁对象

private ReadWriteLock rwLock = new ReentrantReadWriteLock();

//放数据

public void put(String key,Object value) {

//添加写锁

rwLock.writeLock().lock();

try {

System.out.println(Thread.currentThread().getName()+" 正在写操作"+key);

//暂停一会

TimeUnit.MICROSECONDS.sleep(300);

//放数据

map.put(key,value);

System.out.println(Thread.currentThread().getName()+" 写完了"+key);

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

//释放写锁

rwLock.writeLock().unlock();

}

}

//取数据

public Object get(String key) {

//添加读锁

rwLock.readLock().lock();

Object result = null;

try {

System.out.println(Thread.currentThread().getName()+" 正在读取操作"+key);

//暂停一会

TimeUnit.MICROSECONDS.sleep(300);

result = map.get(key);

System.out.println(Thread.currentThread().getName()+" 取完了"+key);

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

//释放读锁

rwLock.readLock().unlock();

}

return result;

}

}

public class ReadWriteLockDemo {

public static void main(String[] args) throws InterruptedException {

MyCache myCache = new MyCache();

//创建线程放数据

for (int i = 1; i \<=5; i++) {

final int num = i;

new Thread(()->{

myCache.put(num+"",num+"");

},String.valueOf(i)).start();

}

TimeUnit.MICROSECONDS.sleep(300);

//创建线程取数据

for (int i = 1; i \<=5; i++) {

final int num = i;

new Thread(()->{

myCache.get(num+"");

},String.valueOf(i)).start();

}

}

}使用StampedLock

- StampedLock提供了乐观读锁,可取代ReadWriteLock以进一步提升并发性能;StampedLock是不可重入锁。

使用Concurrent集合

- 使用java.util.concurrent包提供的线程安全的并发集合可以大大简化多线程编程:

多线程同时读写并发集合是安全的;

尽量使用Java标准库提供的并发集合,避免自己编写同步代码。

使用Atomic

- 使用java.util.concurrent.atomic提供的原子操作可以简化多线程编程:

原子操作实现了无锁的线程安全;

适用于计数器,累加器等。

- 增加值并返回新值:int addAndGet(int delta)

加1后返回新值:int incrementAndGet()

获取当前值:int get()

用CAS方式设置:int compareAndSet(int expect, int update)

使用 Future

- 对线程池提交一个Callable任务,可以获得一个Future对象;

可以用Future在将来某个时刻获取结果。

使用 CompletableFuture

- CompletableFuture可以指定异步处理流程:

thenAccept()处理正常结果;

exceptional()处理异常结果;

thenApplyAsync()用于串行化另一个CompletableFuture;

anyOf()和allOf()用于并行化多个CompletableFuture。

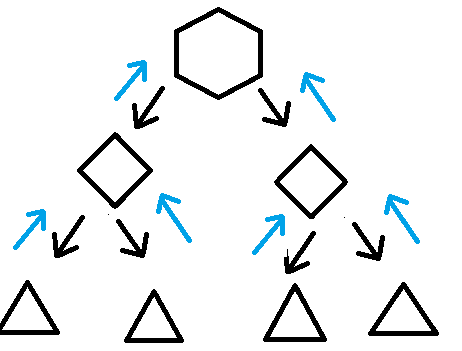

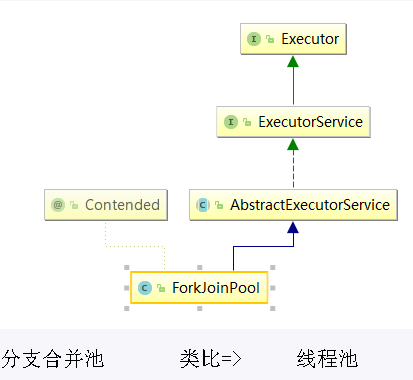

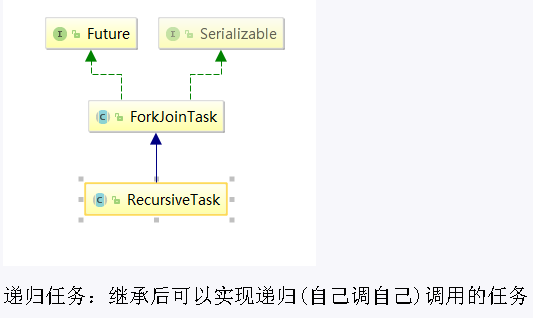

使用 ForkJoin

- Fork/Join是一种基于“分治”的算法:通过分解任务,并行执行,最后合并结果得到最终结果。

ForkJoinPool线程池可以把一个大任务分拆成小任务并行执行,任务类必须继承自RecursiveTask或RecursiveAction。

使用Fork/Join模式可以进行并行计算以提高效率。

使用 ThreadLocal

- ThreadLocal表示线程的“局部变量”,它确保每个线程的ThreadLocal变量都是各自独立的;

ThreadLocal适合在一个线程的处理流程中保持上下文(避免了同一参数在所有方法中传递);

使用ThreadLocal要用try ... finally结构,并在finally中清除。

集合线程安全

public static void main(String[] args) {

//创建ArrayList集合

// List\<String> list = new ArrayList\<>();

// Vector解决

// List\<String> list = new Vector\<>();

//Collections解决

// List\<String> list = Collections.synchronizedList(new ArrayList\<>());

// CopyOnWriteArrayList写时复制技术解决

// List\<String> list = new CopyOnWriteArrayList\<>();

// for (int i = 0; i \<30; i++) {

// new Thread(()->{

// //向集合添加内容

// list.add(UUID.randomUUID().toString().substring(0,8));

// //从集合获取内容

// System.out.println(list);

// },String.valueOf(i)).start();

// }

//演示Hashset

// Set\<String> set = new HashSet\<>();

// Set\<String> set = new CopyOnWriteArraySet\<>();

// for (int i = 0; i \<30; i++) {

// new Thread(()->{

// //向集合添加内容

// set.add(UUID.randomUUID().toString().substring(0,8));

// //从集合获取内容

// System.out.println(set);

// },String.valueOf(i)).start();

// }

//演示HashMap

// Map\<String,String> map = new HashMap\<>();

Map\<String,String> map = new ConcurrentHashMap\<>();

for (int i = 0; i \<30; i++) {

String key = String.valueOf(i);

new Thread(()->{

//向集合添加内容

map.put(key,UUID.randomUUID().toString().substring(0,8));

//从集合获取内容

System.out.println(map);

},String.valueOf(i)).start();

}

}JUC三大辅助类

JUC中提供了三种常用的辅助类,通过这些辅助类可以很好的解决线程数量过多时Lock锁的频繁操作。这三种辅助类为:

• CountDownLatch: 减少计数

• CyclicBarrier: 循环栅栏

• Semaphore: 信号灯

CountDownLatch:减少计数

CountDownLatch类可以设置一个计数器,然后通过countDown方法来进行减1的操作,使用await方法等待计数器不大于0,然后继续执行await方法之后的语句。

• CountDownLatch主要有两个方法,当一个或多个线程调用await方法时,这些线程会阻塞

• 其它线程调用countDown方法会将计数器减1(调用countDown方法的线程不会阻塞)

• 当计数器的值变为0时,因await方法阻塞的线程会被唤醒,继续执行

package com.atguigu.juc;

import java.util.concurrent.CountDownLatch;

//演示 CountDownLatch

public class CountDownLatchDemo {

//6个同学陆续离开教室之后,班长锁门

public static void main(String[] args) throws InterruptedException {

//创建CountDownLatch对象,设置初始值

CountDownLatch countDownLatch = new CountDownLatch(6);

//6个同学陆续离开教室之后

for (int i = 1; i \<=6; i++) {

new Thread(()->{

System.out.println(Thread.currentThread().getName()+" 号同学离开了教室");

//计数 -1

countDownLatch.countDown();

},String.valueOf(i)).start();

}

//等待

countDownLatch.await();

System.out.println(Thread.currentThread().getName()+" 班长锁门走人了");

}

}CyclicBarrier: 循环栅栏

CyclicBarrier看英文单词可以看出大概就是循环阻塞的意思,在使用中CyclicBarrier的构造方法第一个参数是目标障碍数,每次执行CyclicBarrier一次障碍数会加一,如果达到了目标障碍数,才会执行cyclicBarrier.await()之后的语句。可以将CyclicBarrier理解为加1操作

package com.atguigu.juc;

import java.util.concurrent.BrokenBarrierException;

import java.util.concurrent.CyclicBarrier;

//集齐7颗龙珠就可以召唤神龙

public class CyclicBarrierDemo {

//创建固定值

private static final int NUMBER = 7;

public static void main(String[] args) {

//创建CyclicBarrier

CyclicBarrier cyclicBarrier =

new CyclicBarrier(NUMBER,()->{

System.out.println("*****集齐7颗龙珠就可以召唤神龙");

});

//集齐七颗龙珠过程

for (int i = 1; i \<=7; i++) {

new Thread(()->{

try {

System.out.println(Thread.currentThread().getName()+" 星龙被收集到了");

//等待

cyclicBarrier.await();

} catch (Exception e) {

e.printStackTrace();

}

},String.valueOf(i)).start();

}

}

}Semaphore: 信号灯

Semaphore的构造方法中传入的第一个参数是最大信号量(可以看成最大线程池),每个信号量初始化为一个最多只能分发一个许可证。使用acquire方法获得许可证,release方法释放许可。场景: 抢车位, 6部汽车3个停车位

package com.atguigu.juc;

import java.util.Random;

import java.util.concurrent.Semaphore;

import java.util.concurrent.TimeUnit;

//6辆汽车,停3个车位

public class SemaphoreDemo {

public static void main(String[] args) {

//创建Semaphore,设置许可数量

Semaphore semaphore = new Semaphore(3);

//模拟6辆汽车

for (int i = 1; i \<=6; i++) {

new Thread(()->{

try {

//抢占

semaphore.acquire();

System.out.println(Thread.currentThread().getName()+" 抢到了车位");

//设置随机停车时间

TimeUnit.SECONDS.sleep(new Random().nextInt(5));

System.out.println(Thread.currentThread().getName()+" ------离开了车位");

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

//释放

semaphore.release();

}

},String.valueOf(i)).start();

}

}

}阻塞队列

BlockingQueue

Concurrent包中,BlockingQueue很好的解决了多线程中,如何高效安全“传输”数据的问题。通过这些高效并且线程安全的队列类,为我们快速搭建高质量的多线程程序带来极大的便利。本文详细介绍了BlockingQueue家庭中的所有成员,包括他们各自的功能以及常见使用场景。

阻塞队列,顾名思义,首先它是一个队列, 通过一个共享的队列,可以使得数据由队列的一端输入,从另外一端输出;

当队列是空的,从队列中获取元素的操作将会被阻塞

当队列是满的,从队列中添加元素的操作将会被阻塞

试图从空的队列中获取元素的线程将会被阻塞,直到其他线程往空的队列插入新的元素

试图向已满的队列中添加新元素的线程将会被阻塞,直到其他线程从队列中移除一个或多个元素或者完全清空,使队列变得空闲起来并后续新增

常用的队列主要有以下两种:

• 先进先出(FIFO):先插入的队列的元素也最先出队列,类似于排队的功能。从某种程度上来说这种队列也体现了一种公平性

• 后进先出(LIFO):后插入队列的元素最先出队列,这种队列优先处理最近发生的事件(栈)

在多线程领域:所谓阻塞,在某些情况下会挂起线程(即阻塞),一旦条件满足,被挂起的线程又会自动被唤起

为什么需要BlockingQueue

好处是我们不需要关心什么时候需要阻塞线程,什么时候需要唤醒线程,因为这一切BlockingQueue都给你一手包办了

在concurrent包发布以前,在多线程环境下,我们必须去自己控制这些细节,尤其还要兼顾效率和线程安全,而这会给我们的程序带来不小的复杂度。

多线程环境中,通过队列可以很容易实现数据共享,比如经典的“生产者”和“消费者”模型中,通过队列可以很便利地实现两者之间的数据共享。假设我们有若干生产者线程,另外又有若干个消费者线程。如果生产者线程需要把准备好的数据共享给消费者线程,利用队列的方式来传递数据,就可以很方便地解决他们之间的数据共享问题。但如果生产者和消费者在某个时间段内,万一发生数据处理速度不匹配的情况呢?理想情况下,如果生产者产出数据的速度大于消费者消费的速度,并且当生产出来的数据累积到一定程度的时候,那么生产者必须暂停等待一下(阻塞生产者线程),以便等待消费者线程把累积的数据处理完毕,反之亦然。

• 当队列中没有数据的情况下,消费者端的所有线程都会被自动阻塞(挂起),直到有数据放入队列

• 当队列中填满数据的情况下,生产者端的所有线程都会被自动阻塞(挂起),直到队列中有空的位置,线程被自动唤醒

BlockingQueue核心方法

1.放入数据

• offer(anObject):表示如果可能的话,将anObject加到BlockingQueue里,即如果BlockingQueue可以容纳,则返回true,否则返回false.(本方法不阻塞当前执行方法的线程)

• offer(E o, long timeout, TimeUnit unit):可以设定等待的时间,如果在指定的时间内,还不能往队列中加入BlockingQueue,则返回失败

• put(anObject):把anObject加到BlockingQueue里,如果BlockQueue没有空间,则调用此方法的线程被阻断直到BlockingQueue里面有空间再继续.

2.获取数据

• poll(time): 取走BlockingQueue里排在首位的对象,若不能立即取出,则可以等time参数规定的时间,取不到时返回null

• poll(long timeout, TimeUnit unit):从BlockingQueue取出一个队首的对象,如果在指定时间内,队列一旦有数据可取,则立即返回队列中的数据。否则知道时间超时还没有数据可取,返回失败。

• take(): 取走BlockingQueue里排在首位的对象,若BlockingQueue为空,阻断进入等待状态直到BlockingQueue有新的数据被加入;

• drainTo(): 一次性从BlockingQueue获取所有可用的数据对象(还可以指定获取数据的个数),通过该方法,可以提升获取数据效率;不需要多次分批加锁或释放锁。

package com.atguigu.queue;

import java.util.concurrent.ArrayBlockingQueue;

import java.util.concurrent.BlockingQueue;

import java.util.concurrent.Executors;

import java.util.concurrent.TimeUnit;

//阻塞队列

public class BlockingQueueDemo {

public static void main(String[] args) throws InterruptedException {

//创建阻塞队列

BlockingQueue\<String> blockingQueue = new ArrayBlockingQueue\<>(3);

//第一组

// System.out.println(blockingQueue.add("a"));

//// System.out.println(blockingQueue.add("b"));

//// System.out.println(blockingQueue.add("c"));

//// //System.out.println(blockingQueue.element());

////

//// //System.out.println(blockingQueue.add("w"));

//// System.out.println(blockingQueue.remove());

//// System.out.println(blockingQueue.remove());

//// System.out.println(blockingQueue.remove());

//// System.out.println(blockingQueue.remove());

//第二组

// System.out.println(blockingQueue.offer("a"));

// System.out.println(blockingQueue.offer("b"));

// System.out.println(blockingQueue.offer("c"));

// System.out.println(blockingQueue.offer("www"));

//

// System.out.println(blockingQueue.poll());

// System.out.println(blockingQueue.poll());

// System.out.println(blockingQueue.poll());

// System.out.println(blockingQueue.poll());

//第三组 put 没空间阻塞 take 没数据阻塞

// blockingQueue.put("a");

// blockingQueue.put("b");

// blockingQueue.put("c");

// //blockingQueue.put("w");

//

// System.out.println(blockingQueue.take());

// System.out.println(blockingQueue.take());

// System.out.println(blockingQueue.take());

// System.out.println(blockingQueue.take());

//第四组

System.out.println(blockingQueue.offer("a"));

System.out.println(blockingQueue.offer("b"));

System.out.println(blockingQueue.offer("c"));

System.out.println(blockingQueue.offer("w",3L, TimeUnit.SECONDS));

}

}ArrayBlockingQueue(常用)

基于数组的阻塞队列实现,在ArrayBlockingQueue内部,维护了一个定长数组,以便缓存队列中的数据对象,这是一个常用的阻塞队列,除了一个定长数组外,ArrayBlockingQueue内部还保存着两个整形变量,分别标识着队列的头部和尾部在数组中的位置。

ArrayBlockingQueue在生产者放入数据和消费者获取数据,都是共用同一个锁对象,由此也意味着两者无法真正并行运行,这点尤其不同于LinkedBlockingQueue;按照实现原理来分析,ArrayBlockingQueue完全可以采用分离锁,从而实现生产者和消费者操作的完全并行运行。Doug Lea之所以没这样去做,也许是因为ArrayBlockingQueue的数据写入和获取操作已经足够轻巧,以至于引入独立的锁机制,除了给代码带来额外的复杂性外,其在性能上完全占不到任何便宜。 ArrayBlockingQueue和LinkedBlockingQueue间还有一个明显的不同之处在于,前者在插入或删除元素时不会产生或销毁任何额外的对象实例,而后者则会生成一个额外的Node对象。这在长时间内需要高效并发地处理大批量数据的系统中,其对于GC的影响还是存在一定的区别。而在创建ArrayBlockingQueue时,我们还可以控制对象的内部锁是否采用公平锁,默认采用非公平锁。

一句话总结: 由数组结构组成的有界阻塞队列。

LinkedBlockingQueue(常用)

基于链表的阻塞队列,同ArrayListBlockingQueue类似,其内部也维持着一个数据缓冲队列(该队列由一个链表构成),当生产者往队列中放入一个数据时,队列会从生产者手中获取数据,并缓存在队列内部,而生产者立即返回;只有当队列缓冲区达到最大值缓存容量时(LinkedBlockingQueue可以通过构造函数指定该值),才会阻塞生产者队列,直到消费者从队列中消费掉一份

数据,生产者线程会被唤醒,反之对于消费者这端的处理也基于同样的原理。而LinkedBlockingQueue之所以能够高效的处理并发数据,还因为其对于生产者端和消费者端分别采用了独立的锁来控制数据同步,这也意味着在高并发的情况下生产者和消费者可以并行地操作队列中的数据,以此来提高整个队列的并发性能。

ArrayBlockingQueue和LinkedBlockingQueue是两个最普通也是最常用的阻塞队列,一般情况下,在处理多线程间的生产者消费者问题,使用这两个类足以。

一句话总结: 由链表结构组成的有界(但大小默认值为integer.MAX_VALUE)阻塞队列。

DelayQueue

DelayQueue中的元素只有当其指定的延迟时间到了,才能够从队列中获取到该元素。DelayQueue是一个没有大小限制的队列,因此往队列中插入数据的操作(生产者)永远不会被阻塞,而只有获取数据的操作(消费者)才会被阻塞。

一句话总结: 使用优先级队列实现的延迟无界阻塞队列。

PriorityBlockingQueue

基于优先级的阻塞队列(优先级的判断通过构造函数传入的Compator对象来决定),但需要注意的是PriorityBlockingQueue并不会阻塞数据生产者,而只会在没有可消费的数据时,阻塞数据的消费者。

因此使用的时候要特别注意,生产者生产数据的速度绝对不能快于消费者消费数据的速度,否则时间一长,会最终耗尽所有的可用堆内存空间。

在实现PriorityBlockingQueue时,内部控制线程同步的锁采用的是公平锁。

一句话总结: 支持优先级排序的无界阻塞队列。

SynchronousQueue

一种无缓冲的等待队列,类似于无中介的直接交易,有点像原始社会中的生产者和消费者,生产者拿着产品去集市销售给产品的最终消费者,而消费者必须亲自去集市找到所要商品的直接生产者,如果一方没有找到合适的目标,那么对不起,大家都在集市等待。相对于有缓冲的BlockingQueue来说,少了一个中间经销商的环节(缓冲区),如果有经销商,生产者直接把产品批发给经销商,而无需在意经销商最终会将这些产品卖给那些消费者,由于经销商可以库存一部分商品,因此相对于直接交易模式,总体来说采用中间经销商的模式会吞吐量高一些(可以批量买卖);但另一方面,又因为经销商的引入,使得产品从生产者到消费者中间增加了额外的交易环节,单个产品的及时响应性能可能会降低。

声明一个SynchronousQueue有两种不同的方式,它们之间有着不太一样的行为。

公平模式和非公平模式的区别:

• 公平模式:SynchronousQueue会采用公平锁,并配合一个FIFO队列来阻塞多余的生产者和消费者,从而体系整体的公平策略;

• 非公平模式(SynchronousQueue默认):SynchronousQueue采用非公平锁,同时配合一个LIFO队列来管理多余的生产者和消费者,而后一种模式,如果生产者和消费者的处理速度有差距,则很容易出现饥渴的情况,即可能有某些生产者或者是消费者的数据永远都得不到处理。

一句话总结: 不存储元素的阻塞队列,也即单个元素的队列。

LinkedTransferQueue

LinkedTransferQueue是一个由链表结构组成的无界阻塞TransferQueue队列。相对于其他阻塞队列,LinkedTransferQueue多了tryTransfer和transfer方法。

LinkedTransferQueue采用一种预占模式。意思就是消费者线程取元素时,如果队列不为空,则直接取走数据,若队列为空,那就生成一个节点(节点元素为null)入队,然后消费者线程被等待在这个节点上,后面生产者线程入队时发现有一个元素为null的节点,生产者线程就不入队了,直接就将元素填充到该节点,并唤醒该节点等待的线程,被唤醒的消费者线程取走元素,从调用的方法返回。

一句话总结: 由链表组成的无界阻塞队列。

LinkedBlockingDeque

LinkedBlockingDeque是一个由链表结构组成的双向阻塞队列,即可以从队列的两端插入和移除元素。

对于一些指定的操作,在插入或者获取队列元素时如果队列状态不允许该操作可能会阻塞住该线程直到队列状态变更为允许操作,这里的阻塞一般有两种情况

• 插入元素时: 如果当前队列已满将会进入阻塞状态,一直等到队列有空的位置时再讲该元素插入,该操作可以通过设置超时参数,超时后返回 false 表示操作失败,也可以不设置超时参数一直阻塞,中断后抛出InterruptedException异常

• 读取元素时: 如果当前队列为空会阻塞住直到队列不为空然后返回元素,同样可以通过设置超时参数

一句话总结: 由链表组成的双向阻塞队列

小结

- 在多线程领域:所谓阻塞,在某些情况下会挂起线程(即阻塞),一旦条件满足,被挂起的线程又会自动被唤起

- 为什么需要BlockingQueue? 在concurrent包发布以前,在多线程环境下,我们每个程序员都必须去自己控制这些细节,尤其还要兼顾效率和线程安全,而这会给我们的程序带来不小的复杂度。使用后我们不需要关心什么时候需要阻塞线程,什么时候需要唤醒线程,因为这一切BlockingQueue都给你一手包办了

线程池

线程池(Thread Pool):一种线程使用模式。线程过多会带来调度开销,进而影响缓存局部性和整体性能。而线程池维护着多个线程,等待着监督管理者分配可并发执行的任务。这避免了在处理短时间任务时创建与销毁线程的代价。线程池不仅能够保证内核的充分利用,还能防止过分调度。

例子:以前单核CPU电脑,假的多线程,像马戏团小丑玩多个球,CPU需要来回切换。 现在多核电脑,多个线程各自跑在独立的CPU上,不用切换效率高。

优势:

线程池做的工作只要是控制运行的线程数量,处理过程中将任务放入队列,然后在线程创建后启动这些任务,如果线程数量超过了最大数量,超出数量的线程排队等候,等其他线程执行完毕,再从队列中取出任务来执行。

特点:

• 降低资源消耗: 通过重复利用已创建的线程降低线程创建和销毁造成的销耗。

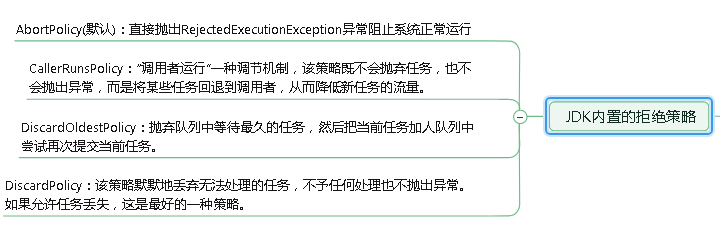

• 提高响应速度: 当任务到达时,任务可以不需要等待线程创建就能立即执行。